Kapitola 11 Aplikace na reálných datech 2

V této části dokumentu se budeme zabývat aplikací dříve popsaných metod (pro více podrobností viz například Kapitolu 5) na reálná data phoneme, která jsou dostupná například na této adrese. Podrobný popis dat pak můžeme nalézt zde. Jedná se o datový soubor obsahující log-periodogramy (zvukový záznam řeči) celkem 50 mužů, přičemž od každého jedince máme k dispozici několik zvukových záznamů. V datovém souboru rozlišujeme celkem pět různých hlásek – aa, ao, dcl, iy, sh. Naší úlohou bude klasifikovat log-periodogramy do těchto skupin, tedy bude nás zajímat predikce pro nový log-periodogram.

Nejprve si data načteme z textového souboru phoneme.txt a upravíme datový soubor tak, aby byl vhodný pro další analýzu.

Code

# nacteme potrebne balicky

library(fda)

library(ggplot2)

library(dplyr)

library(tidyr)

library(ddalpha)

library(tidyverse)

set.seed(42)

# nacteni dat

data <- read.delim2('phoneme.txt', header = T, sep = ',')

# zmenime dve promenne na typ factor

data <- data |>

mutate(g = factor(g),

speaker = factor(speaker))

# numericke promenne prevedeme opravdu na numericke

data[, 2:257] <- as.numeric(data[, 2:257] |> as.matrix())Podíváme se na popisné statistiky faktorových proměnných, tedy zejména nás zajímají absolutní a relativní četnosti hlásek v datovém souboru.

Code

## phoneme count proportion

## 1 aa 695 0.1541362

## 2 ao 1022 0.2266578

## 3 dcl 757 0.1678864

## 4 iy 1163 0.2579286

## 5 sh 872 0.1933910V posledním sloupci datového souboru phoneme jsou uvedeny názvy jednotlivých záznamů, přičemž kromě dalších obsahují i informaci o tom, zda se jedná o trénovací (označení train) nebo testovací (označení test) pozorování. To má pro nás klíčovou roli, neboť podle tohoto označení rozdělíme záznamy na testovací a trénovací množinu.

Code

tr_vs_test <- str_split(data$speaker, '\\.') |> unlist()

tr_vs_test <- tr_vs_test[seq(1, length(tr_vs_test), by = 4)]

data$train <- ifelse(tr_vs_test == 'train', TRUE, FALSE)

data.frame(count = tr_vs_test |> factor() |> summary(),

proportion = tr_vs_test |> factor() |>

summary() / length(tr_vs_test))## count proportion

## test 1169 0.2592593

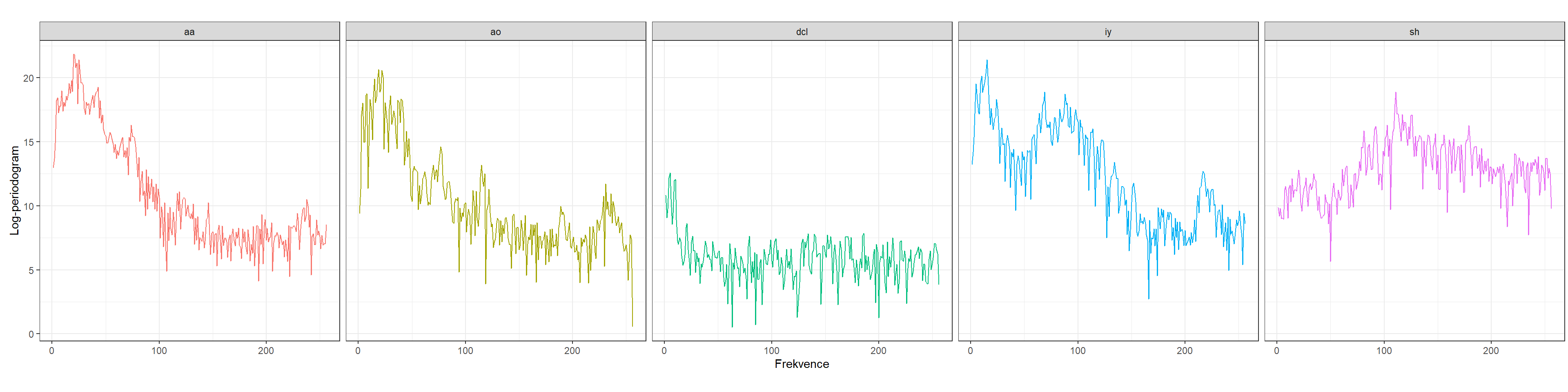

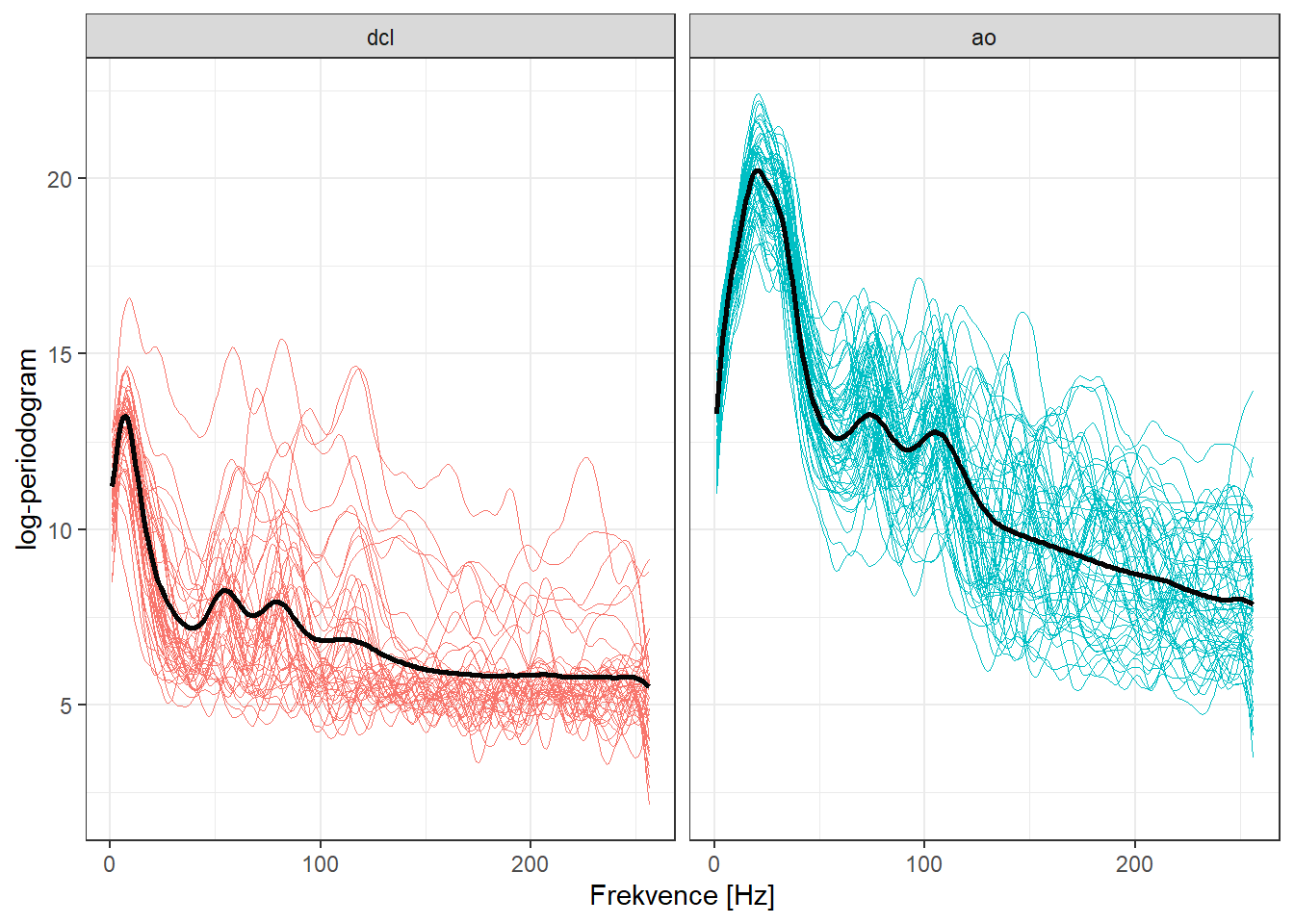

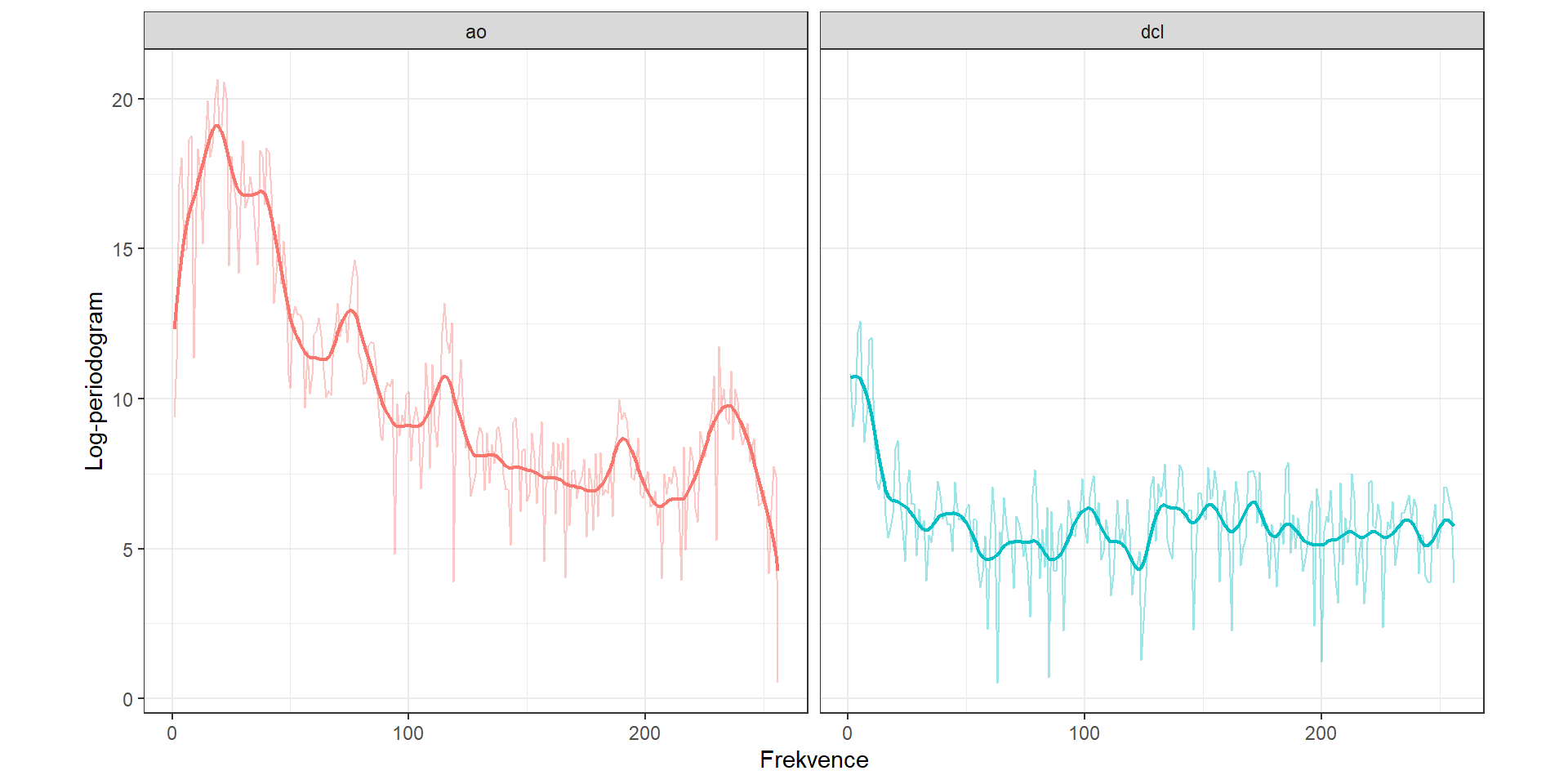

## train 3340 0.7407407Vykresleme si pro lepší představu log-periodogramy jednotlivých fonémů. Z obrázku níže můžeme vidět, že nejvíce si podobné co do průběhu jsou log-periodogramy pro fonémy aa a ao. Vybereme si pro klasifikaci tyto dva fonémy a naším cílem bude porovnat metody popsané v předchozích kapitolách z hlediska úspěšnosti klasifikace.

Code

n_plot <- 5

data[c(1, 2, 3, 5, 9), ] |>

pivot_longer(cols = x.1:x.256, names_to = 'time',

values_to = 'value') |>

mutate(time = rep(1:256, n_plot)) |>

ggplot(aes(x = time, y = value, colour = g, group = interaction(speaker, g))) +

geom_line() +

theme_bw() +

facet_grid(~ g) +

labs(x = 'Frekvence',

y = 'Log-periodogram',

colour = 'Foném') +

# scale_colour_manual(values = rep('deepskyblue2', 5)) +

theme(aspect.ratio = 1,

legend.position = "none",

plot.margin = unit(c(0.1, 0.1, 0.1, 0.3), "cm"))

Obrázek 3.1: Log-periodogramy fonémů pro vybrané záznamy.

Vytvořme si ještě vhodné proměnné v R, do kterých uložíme trénovací a testovací záznamy a také informaci o druhu fonému.

Code

# nastaveni generatoru cisel

set.seed(42)

# pocet trenovacich a testovacich dat

# n_train <- 500

# n_test <- 300

# vybrane fonemy ke klasifikaci

phoneme_subset <- c('aa', 'ao')

# testovaci a trenovaci data

data_train <- data |> filter(train) |> filter(g %in% phoneme_subset)

data_test <- data |> filter(!train) |> filter(g %in% phoneme_subset)

# omezime se pouze na nejakou podmnozinu

# data_train <- data_train[sample(1:dim(data_train)[1], n_train), ]

# data_test <- data_test[sample(1:dim(data_test)[1], n_test), ]

# odstranime sloupce, ktere nenesou informaci o frekvenci a

# transponujeme tak, aby ve sloupcich byly jednotlive zaznamy

X_train <- data_train[, -c(1, 258, 259, 260)] |> t()

X_test <- data_test[, -c(1, 258, 259, 260)] |> t()

# prejmenujeme radky a sloupce

rownames(X_train) <- 1:256

colnames(X_train) <- paste0('train', data_train$row.names)

rownames(X_test) <- 1:256

colnames(X_test) <- paste0('test', data_test$row.names)

# definujeme vektor fonemu

y_train <- data_train[, 258] |> factor(levels = phoneme_subset)

y_test <- data_test[, 258] |> factor(levels = phoneme_subset)

# absolutni cetnosti

data.frame(phoneme = phoneme_subset,

train = table(y_train) |> as.numeric(),

test = table(y_test) |> as.numeric())## phoneme train test

## 1 aa 519 176

## 2 ao 759 26311.1 Vyhlazení pozorovaných křivek

Nyní převedeme pozorované diskrétní hodnoty (vektory hodnot) na funkcionální objekty, se kterými budeme následně pracovat. Jelikož se nejedná o periodické křivky, využijeme k vyhlazení B-sline bázi.

Za uzly bereme celý vektor frekvencí (1 až 256), standardně uvažujeme kubické spliny, proto volíme (implicitní volba v R) norder = 4.

Budeme penalizovat druhou derivaci funkcí.

Code

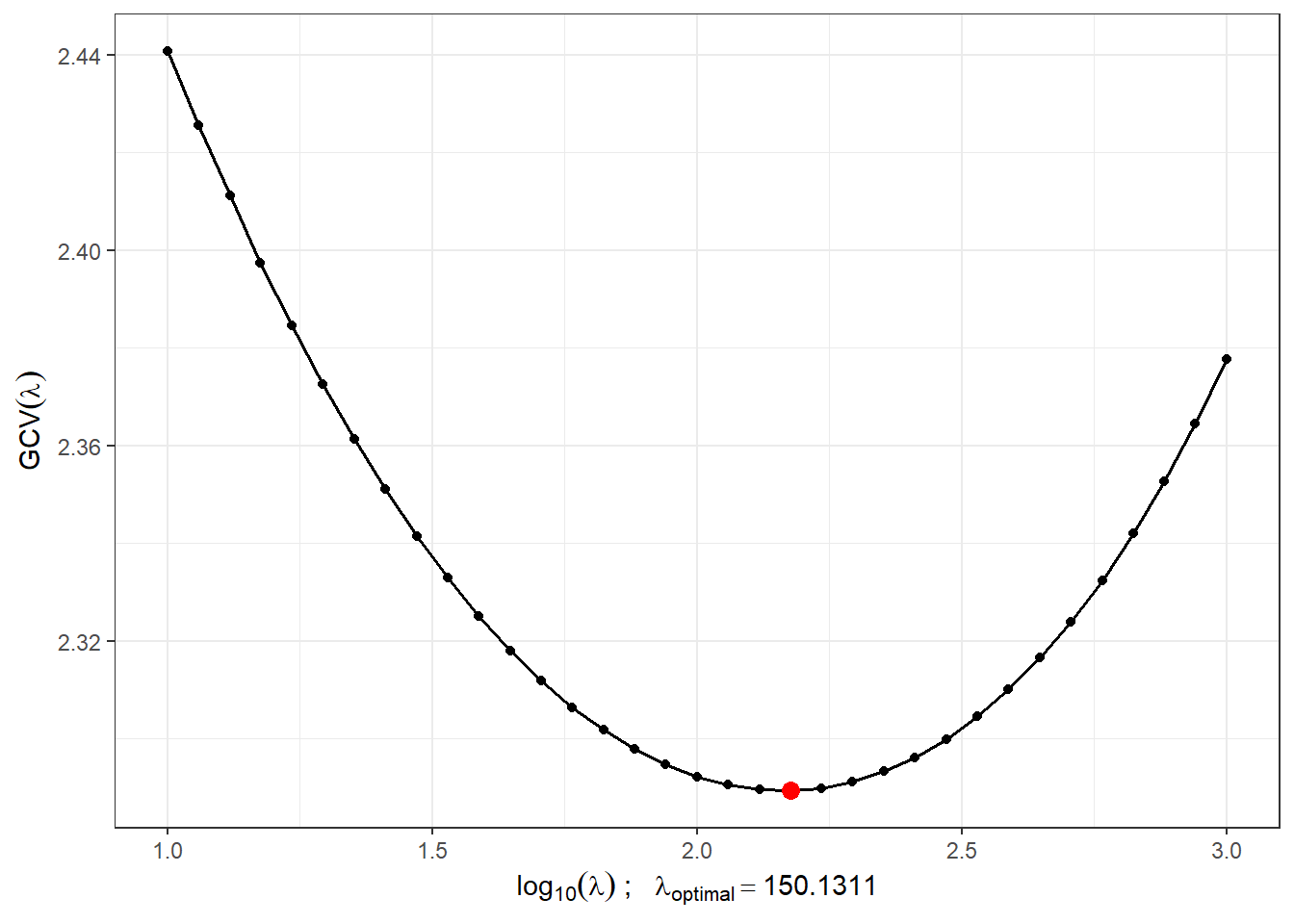

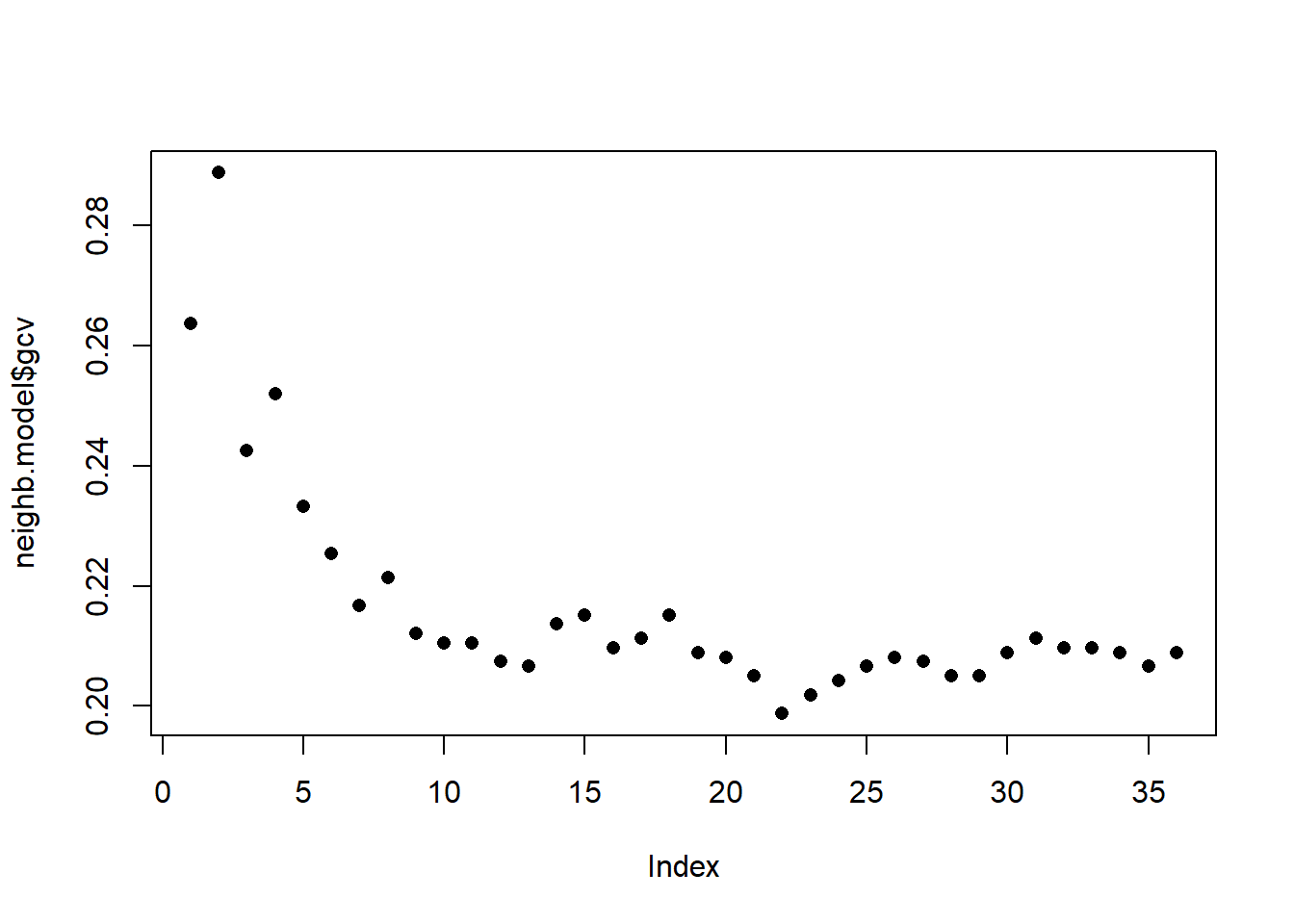

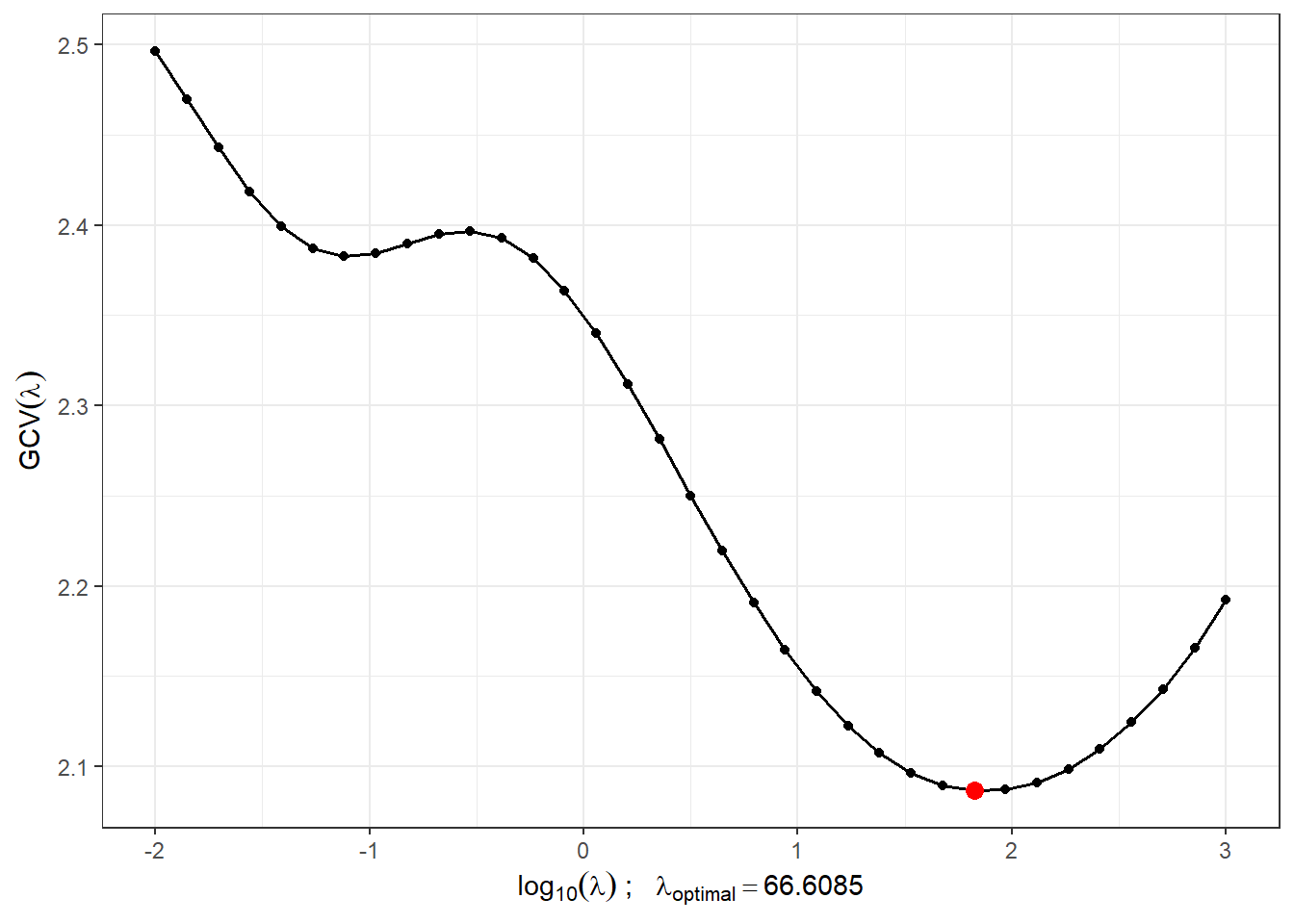

Najdeme vhodnou hodnotu vyhlazovacího parametru \(\lambda > 0\) pomocí \(GCV(\lambda)\), tedy pomocí zobecněné cross–validace. Hodnotu \(\lambda\) budeme uvažovat pro obě klasifikační skupiny stejnou, neboť pro testovací pozorování bychom dopředu nevěděli, kterou hodnotu \(\lambda\), v případě rozdílné volby pro každou třídu, máme volit.

Code

# spojeni pozorovani do jedne matice

XX <- cbind(X_train, X_test) |> as.matrix()

lambda.vect <- 10^seq(from = 1, to = 3, length.out = 35) # vektor lambd

gcv <- rep(NA, length = length(lambda.vect)) # prazdny vektor pro ulozebi GCV

for(index in 1:length(lambda.vect)) {

curv.Fdpar <- fdPar(bbasis, curv.Lfd, lambda.vect[index])

BSmooth <- smooth.basis(t, XX, curv.Fdpar) # vyhlazeni

gcv[index] <- mean(BSmooth$gcv) # prumer pres vsechny pozorovane krivky

}

GCV <- data.frame(

lambda = round(log10(lambda.vect), 3),

GCV = gcv

)

# najdeme hodnotu minima

lambda.opt <- lambda.vect[which.min(gcv)]Pro lepší znázornění si vykreslíme průběh \(GCV(\lambda)\).

Code

GCV |> ggplot(aes(x = lambda, y = GCV)) +

geom_line(linetype = 'solid', linewidth = 0.6) +

geom_point(size = 1.5) +

theme_bw() +

labs(x = bquote(paste(log[10](lambda), ' ; ',

lambda[optimal] == .(round(lambda.opt, 4)))),

y = expression(GCV(lambda))) +

geom_point(aes(x = log10(lambda.opt), y = min(gcv)), colour = 'red', size = 3)

Obrázek 1.3: Průběh \(GCV(\lambda)\) pro zvolený vektor \(\boldsymbol\lambda\). Na ose \(x\) jsou hodnoty vyneseny v logaritmické škále. Červeně je znázorněna optimální hodnota vyhlazovacího parametru \(\lambda_{optimal}\).

S touto optimální volbou vyhlazovacího parametru \(\lambda\) nyní vyhladíme všechny funkce.

Code

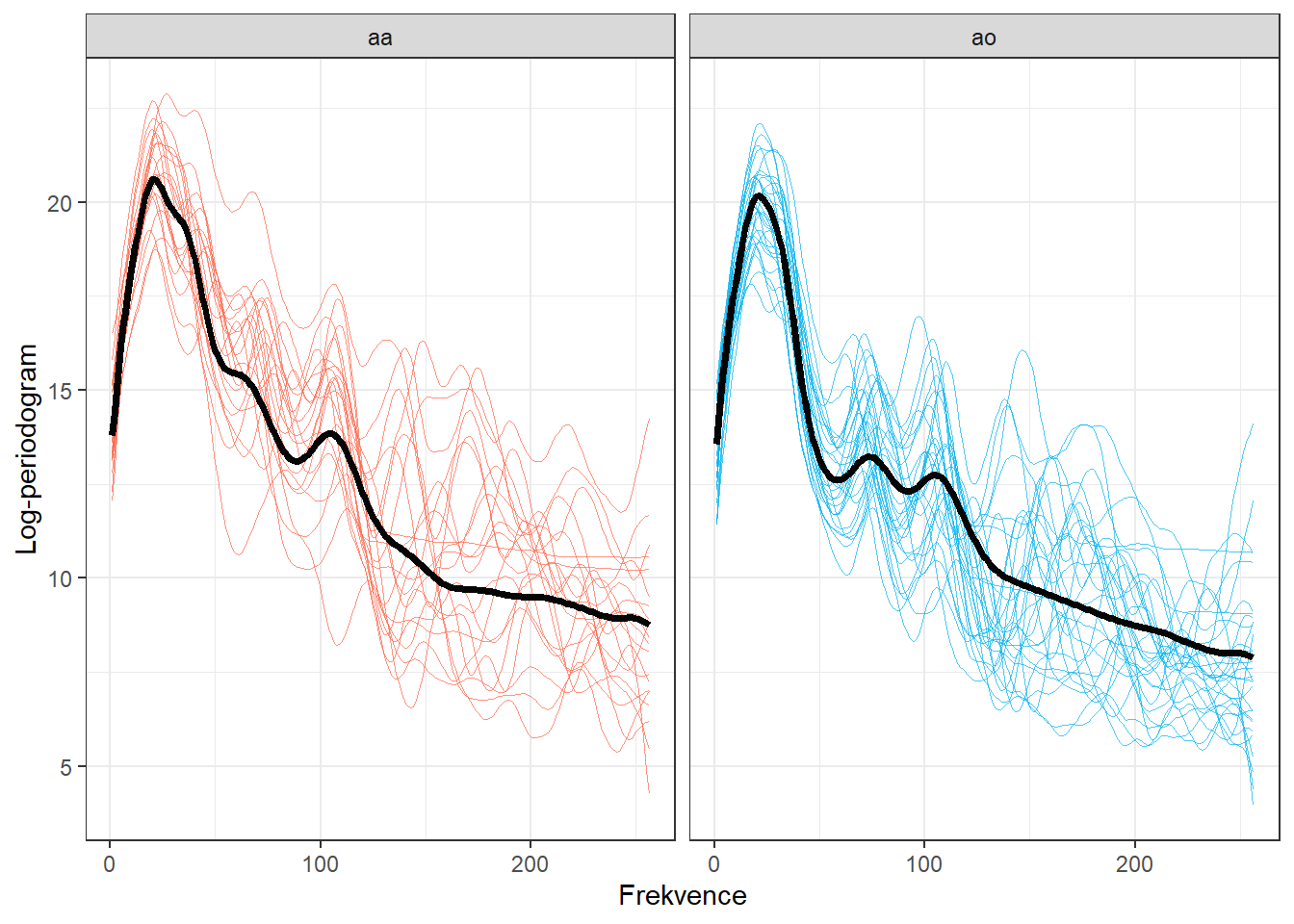

Ještě znázorněme křivky včetně průměru zvlášť pro každou třídu.

Code

# library(tikzDevice)

n <- dim(XX)[2]

y <- c(y_train, y_test)

DFsmooth <- data.frame(

t = rep(t, n),

time = factor(rep(1:n, each = length(t))),

Smooth = c(fdobjSmootheval),

Phoneme = rep(y, each = length(t)))

DFmean <- data.frame(

t = rep(t, 2),

Mean = c(eval.fd(fdobj = mean.fd(XXfd[y == phoneme_subset[1]]), evalarg = t),

eval.fd(fdobj = mean.fd(XXfd[y == phoneme_subset[2]]), evalarg = t)),

Phoneme = factor(rep(phoneme_subset, each = length(t)),

levels = levels(y))

)

DFsmooth |>

filter(time %in% as.character(1:50)) |>

ggplot(aes(x = t, y = Smooth, color = Phoneme)) +

geom_line(aes(group = time), linewidth = 0.05, alpha = 0.7) +

theme_bw() +

labs(x = 'Frekvence',

y = 'Log-periodogram',

colour = 'Phoneme') +

geom_line(data = DFmean, aes(x = t, y = Mean,

group = Phoneme),

linewidth = 1.25, linetype = 'solid', colour = 'grey2') +

facet_wrap(~Phoneme) +

theme(legend.position = 'none') +

scale_colour_manual(values = c('tomato', 'deepskyblue2'),

labels = phoneme_subset)

Obrázek 1.5: Vykreslení prvních 50 vyhlazených pozorovaných křivek, barevně jsou odlišeny křivky podle příslušnosti do klasifikační třídy. Černou čarou je zakreslen průměr pro každou třídu.

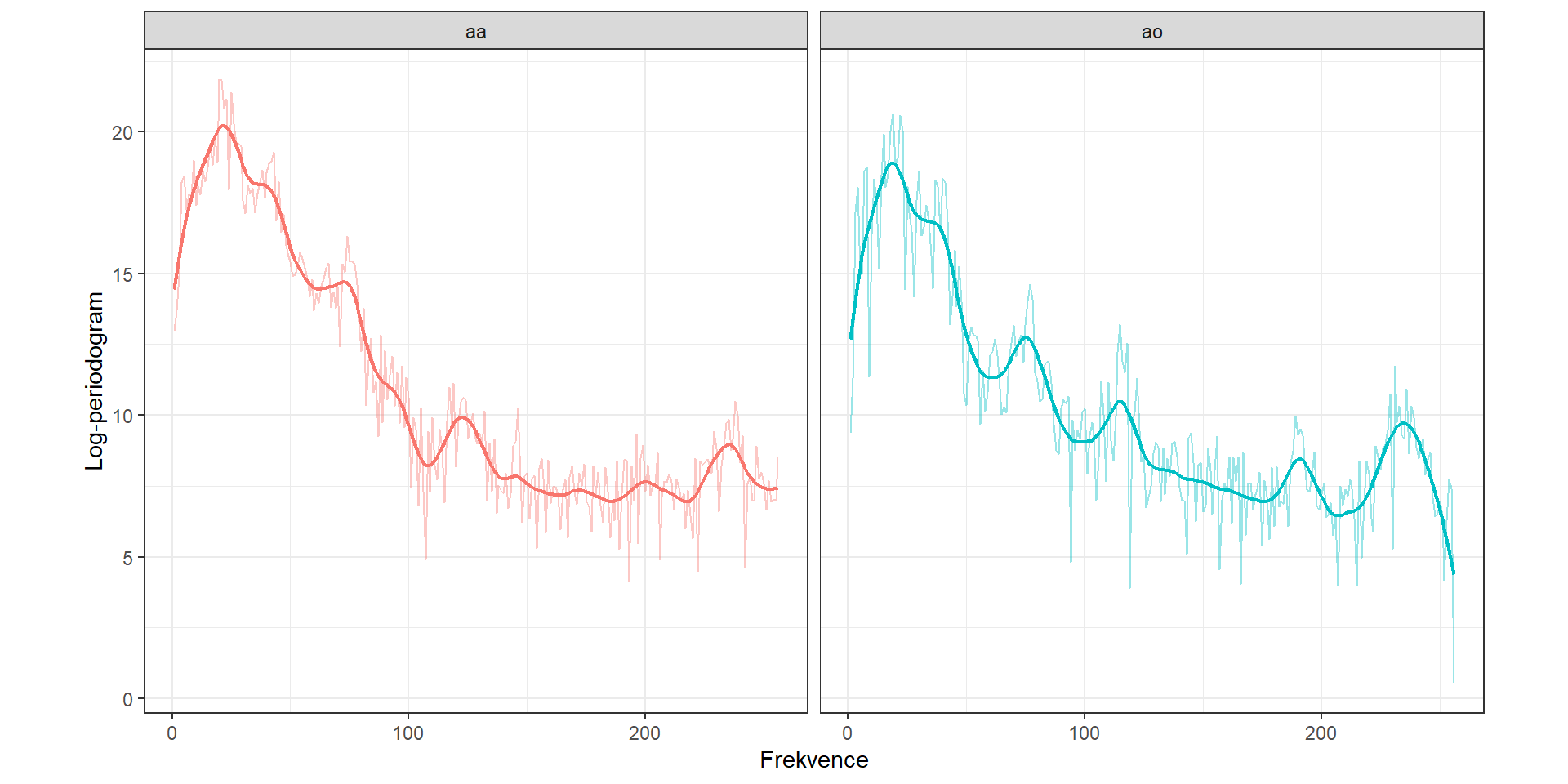

Nakonec této podkapitoly si ještě vykresleme vyhlazené křivky pro vybrané záznamy z grafu pro všechny fonémy výše.

Code

n_plot <- 5

data[c(1, 2, 3, 5, 9), ] |>

pivot_longer(cols = x.1:x.256, names_to = 'time',

values_to = 'value') |>

mutate(time = rep(1:256, n_plot)) |>

filter(g %in% phoneme_subset) |>

ggplot(aes(x = time, y = value, colour = g, group = interaction(speaker, g))) +

geom_line(alpha = 0.4) +

theme_bw() +

facet_grid(~ g) +

labs(x = 'Frekvence',

y = 'Log-periodogram',

colour = 'Foném') +

theme(aspect.ratio = 1,

legend.position = "none") +

geom_line(

data = DFsmooth |> filter(time %in% as.character(c(1, 3))) |>

mutate(g = Phoneme),

aes(x = t, y = Smooth, color = g, group = time), linewidth = 0.8

)

Obrázek 2.1: Log-periodogramy fonémů pro vybrané záznamy.

11.2 Klasifikace křivek

Nejprve načteme potřebné knihovny pro klasifikaci.

Code

library(caTools) # pro rozdeleni na testovaci a trenovaci

library(caret) # pro k-fold CV

library(fda.usc) # pro KNN, fLR

library(MASS) # pro LDA

library(fdapace)

library(pracma)

library(refund) # pro LR na skorech

library(nnet) # pro LR na skorech

library(caret)

library(rpart) # stromy

library(rattle) # grafika

library(e1071)

library(randomForest) # nahodny lesCode

Ještě se podíváme na zastoupení jednotlivých skupin v testovací a trénovací části dat.

## Y.train

## aa ao

## 519 759## Y.test

## aa ao

## 176 263## Y.train

## aa ao

## 0.4061033 0.5938967## Y.test

## aa ao

## 0.4009112 0.599088811.2.1 \(K\) nejbližších sousedů

Začněme neparametrickou klasifikační metodou, a to metodou \(K\) nejbližších sousedů.

Nejprve si vytvoříme potřebné objekty tak, abychom s nimi mohli pomocí funkce classif.knn() z knihovny fda.usc dále pracovat.

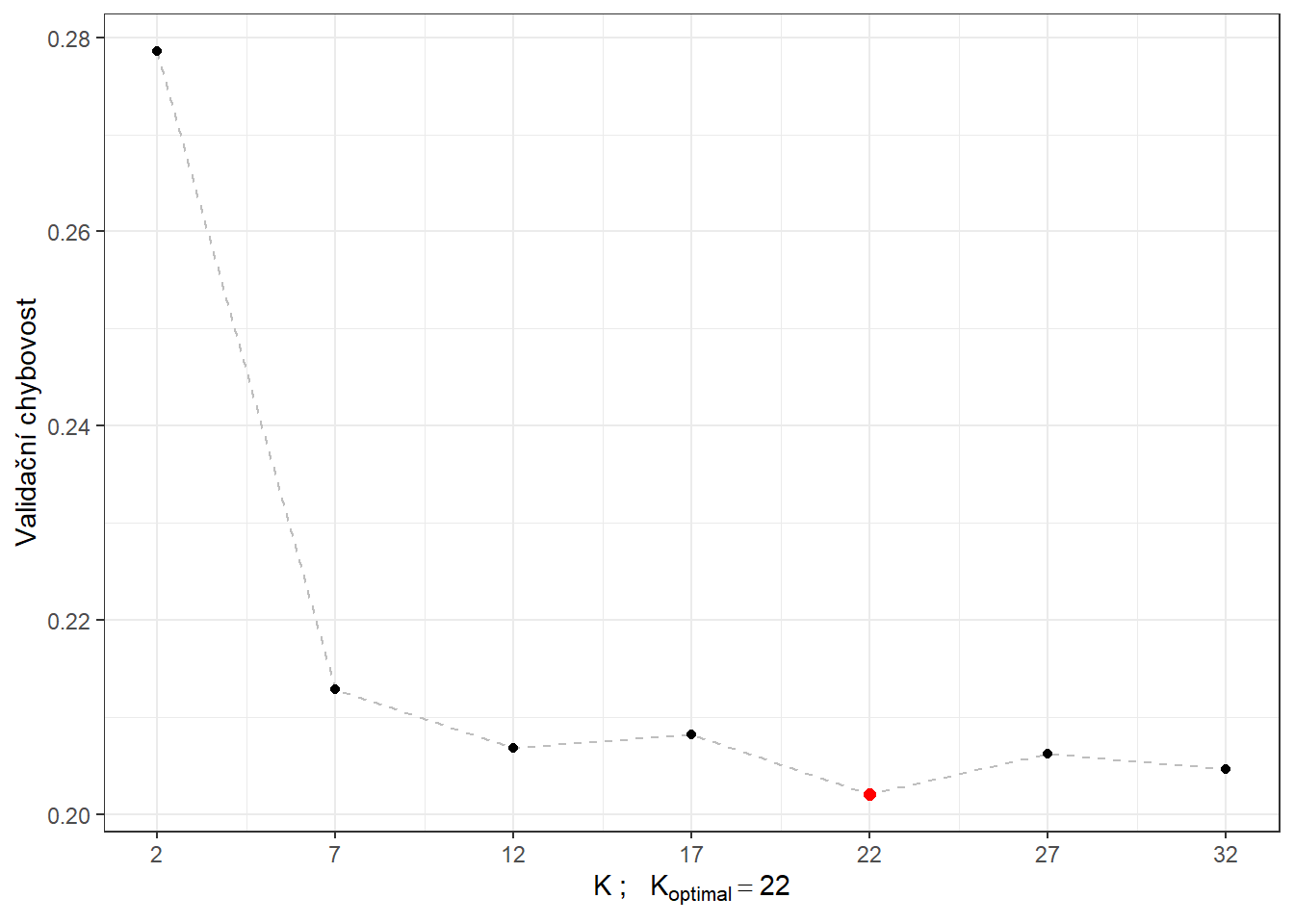

Nyní můžeme definovat model a podívat se na jeho úspěšnost klasifikace. Poslední otázkou však zůstává, jak volit optimální počet sousedů \(K\). Mohli bychom tento počet volit jako takové \(K\), při kterém nastává minimální chybovost na trénovacích datech. To by ale mohlo vést k přeučení modelu, proto využijeme cross-validaci. Vzhledem k výpočetní náročnosti a rozsahu souboru zvolíme \(k\)-násobnou CV, my zvolíme hodnotu \(k = {5}\), neboť výpočet je nyní velmi časově náročný.

Code

## - SUMMARY -

##

## -Probability of correct classification by group (prob.classification):

## y

## 1 2

## 0.6782274 0.8853755

##

## -Confusion matrix between the theoretical groups (by rows)

## and estimated groups (by column)

##

## 1 2

## 1 352 167

## 2 87 672

##

## -Vector of probability of correct classification

## by number of neighbors (knn):

## 1 2 3 4 5 6 7 8 9 10 11

## 0.7363 0.7113 0.7574 0.7480 0.7668 0.7746 0.7833 0.7786 0.7879 0.7895 0.7895

## 12 13 14 15 16 17 18 19 20 21 22

## 0.7926 0.7934 0.7864 0.7848 0.7903 0.7887 0.7848 0.7911 0.7919 0.7950 0.8013

## 23 24 25 26 27 28 29 30 31 32 33

## 0.7981 0.7958 0.7934 0.7919 0.7926 0.7950 0.7950 0.7911 0.7887 0.7903 0.7903

## 34 35 36

## 0.7911 0.7934 0.7911

##

## -Optimal number of neighbors: knn.opt= 22

## with highest probability of correct classification max.prob= 0.801252

##

## -Probability of correct classification: 0.8013

## [1] 0.801252## [1] 22Proveďme předchozí postup pro trénovací data, která rozdělíme na \(k\) částí a tedy zopakujeme tuto část kódu \(k\)-krát.

Code

k_cv <- 5 # k-fold CV

neighbours <- seq(2, 35, by = 5) # pocet sousedu

# rozdelime trenovaci data na k casti

folds <- createMultiFolds(X.train$fdnames$reps, k = k_cv, time = 1)

# prazdna matice, do ktere vlozime jednotlive vysledky

# ve sloupcich budou hodnoty presnosti pro danou cast trenovaci mnoziny

# v radcich budou hodnoty pro danou hodnotu K sousedu

CV.results <- matrix(NA, nrow = length(neighbours), ncol = k_cv)

for (index in 1:k_cv) {

# definujeme danou indexovou mnozinu

fold <- folds[[index]]

x.train.cv <- subset(X.train, c(1:length(X.train$fdnames$reps)) %in% fold) |>

fdata()

y.train.cv <- subset(Y.train, c(1:length(X.train$fdnames$reps)) %in% fold) |>

factor() |> as.numeric()

x.test.cv <- subset(X.train, !c(1:length(X.train$fdnames$reps)) %in% fold) |>

fdata()

y.test.cv <- subset(Y.train, !c(1:length(X.train$fdnames$reps)) %in% fold) |>

factor() |> as.numeric()

# projdeme kazdou cast ... k-krat zopakujeme

for(neighbour in neighbours) {

# model pro konkretni volbu K

neighb.model <- classif.knn(group = y.train.cv,

fdataobj = x.train.cv,

knn = neighbour)

# predikce na validacni casti

model.neighb.predict <- predict(neighb.model,

new.fdataobj = x.test.cv)

# presnost na validacni casti

presnost <- table(y.test.cv, model.neighb.predict) |>

prop.table() |> diag() |> sum()

# presnost vlozime na pozici pro dane K a fold

CV.results[(1:length(neighbours))[neighbour == neighbours], index] <- presnost

#cat('\r', paste0(index, ': ', neighbour))

}

}

# spocitame prumerne presnosti pro jednotliva K pres folds

CV.results <- apply(CV.results, 1, mean)

K.opt <- neighbours[which.max(CV.results)]

presnost.opt.cv <- max(CV.results)

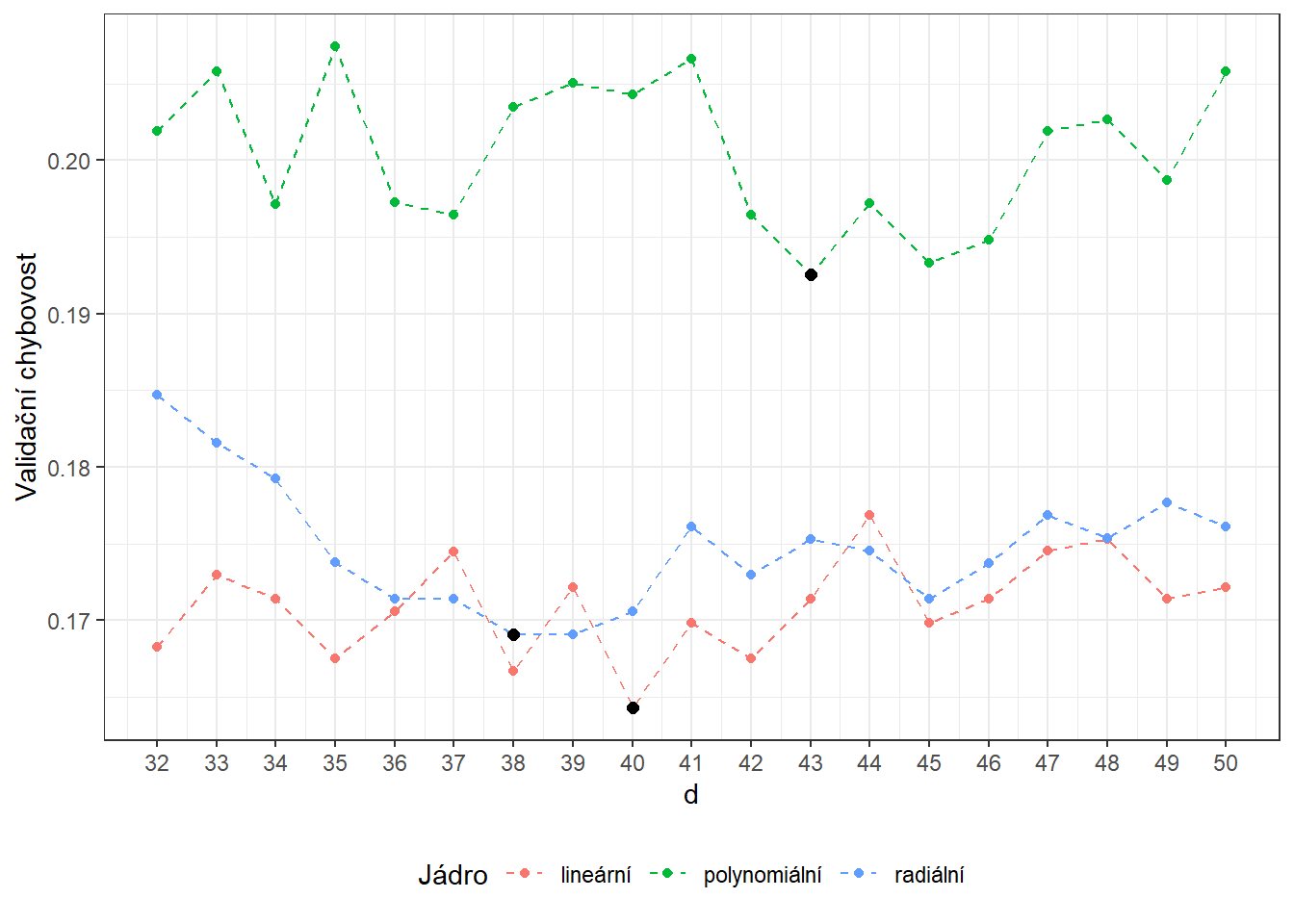

CV.results <- data.frame(K = neighbours, CV = CV.results)Vidíme, že nejlépe vychází hodnota parametru \(K\) jako 22 s hodnotou chybovosti spočtenou pomocí 10-násobné CV 0.202. Pro přehlednost si ještě vykresleme průběh validační chybovosti v závislosti na počtu sousedů \(K\).

Code

CV.results |> ggplot(aes(x = K, y = 1 - CV)) +

geom_line(linetype = 'dashed', colour = 'grey') +

geom_point(size = 1.5) +

geom_point(aes(x = K.opt, y = 1 - presnost.opt.cv), colour = 'red', size = 2) +

theme_bw() +

labs(x = bquote(paste(K, ' ; ',

K[optimal] == .(K.opt))),

y = 'Validační chybovost') +

scale_x_continuous(breaks = neighbours)

Obrázek 5.4: Závislost validační chybovosti na hodnotě \(K\), tedy na počtu sousedů.

Nyní známe optimální hodnotu parametru \(K\) a tudíž můžeme sestavit finální model.

Code

## - SUMMARY -

##

## -Probability of correct classification by group (prob.classification):

## y

## 1 2

## 0.6782274 0.8853755

##

## -Confusion matrix between the theoretical groups (by rows)

## and estimated groups (by column)

##

## 1 2

## 1 352 167

## 2 87 672

##

## -Vector of probability of correct classification

## by number of neighbors (knn):

## 22

## 0.8013

##

## -Optimal number of neighbors: knn.opt= 22

## with highest probability of correct classification max.prob= 0.801252

##

## -Probability of correct classification: 0.8013Code

Vidíme tedy, že chybovost modelu sestrojeného pomocí metody \(K\) nejbližších sousedů s optimální volbou \(K_{optimal}\) rovnou 22, kterou jsme určili cross-validací, je na trénovacích datech rovna 0.1987 a na testovacích datech 0.2073.

K porovnání jendotlivých modelů můžeme použít oba typy chybovostí, pro přehlednost si je budeme ukládat do tabulky.

11.2.2 Lineární diskriminační analýza

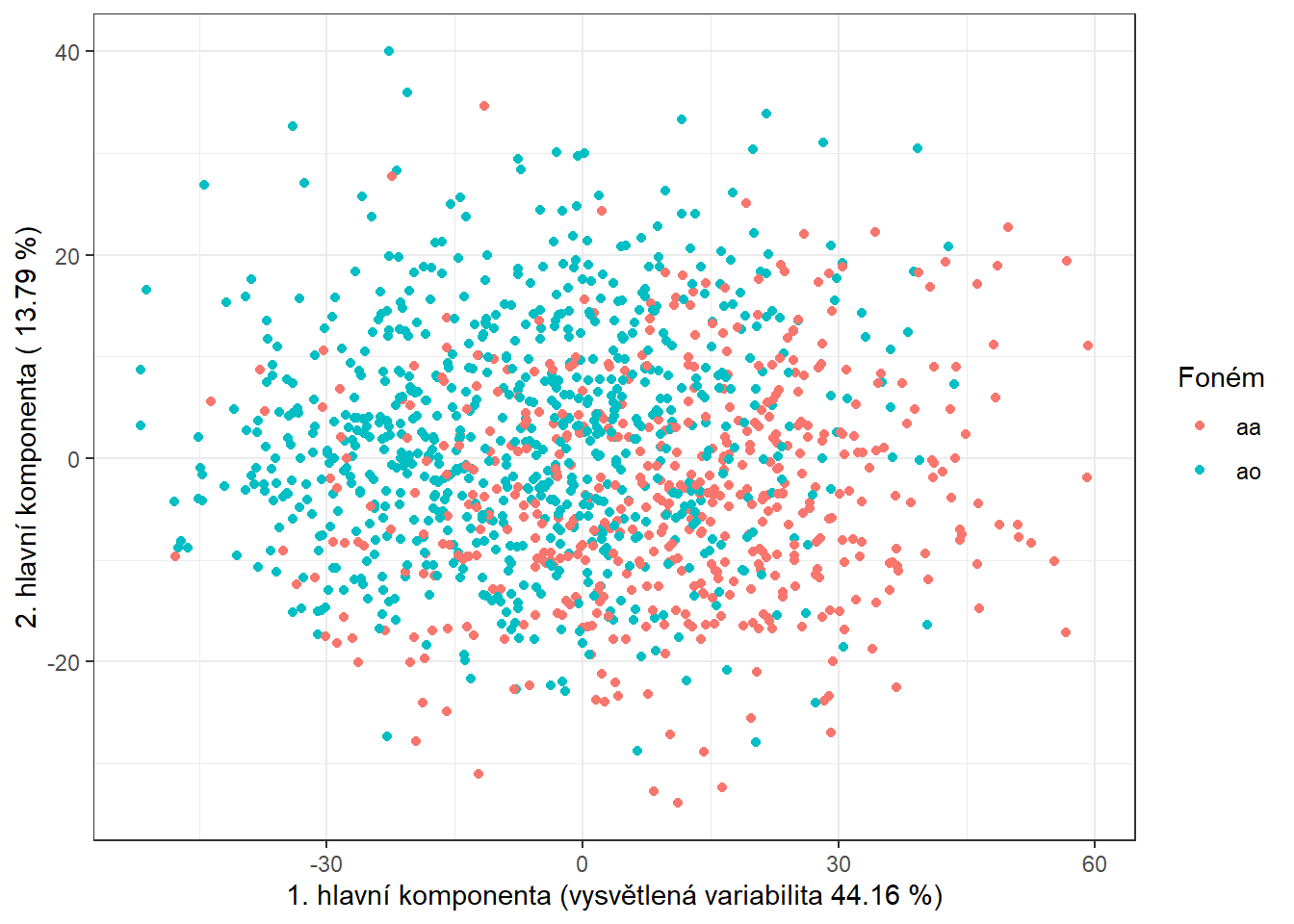

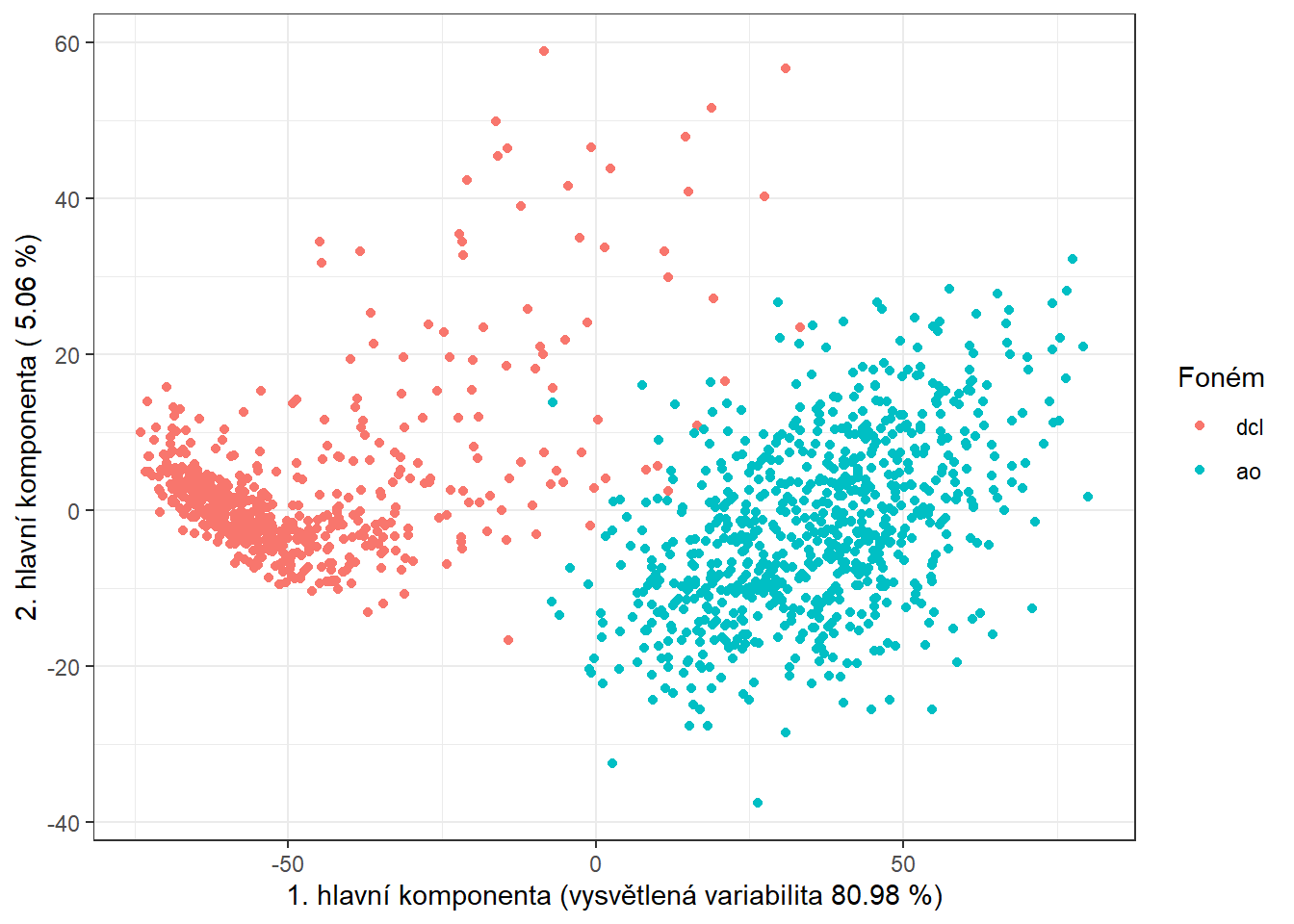

Jako druhou metodu pro sestrojení klasifikátoru budeme uvažovat lineární diskriminační analýzu (LDA). Jelikož tato metoda nelze aplikovat na funkcionální data, musíme je nejprve diskretizovat, což provedeme pomocí funkcionální analýzy hlavních komponent. Klasifikační algoritmus následně provedeme na skórech prvních \(p\) hlavních komponent. Počet komponent \(p\) zvolíme tak, aby prvních \(p\) hlavních komponent dohromady vysvětlovalo alespoň 90 % variability v datech.

Proveďme tedy nejprve funkcionální analýzu hlavních komponent a určeme počet \(p\).

Code

# analyza hlavnich komponent

data.PCA <- pca.fd(X.train, nharm = 10) # nharm - maximalni pocet HK

nharm <- which(cumsum(data.PCA$varprop) >= 0.9)[1] # urceni p

if(nharm == 1) nharm <- 2 # aby bylo mozne vykreslovat grafy,

# potrebujeme alespon 2 HK

data.PCA <- pca.fd(X.train, nharm = nharm)

data.PCA.train <- as.data.frame(data.PCA$scores) # skore prvnich p HK

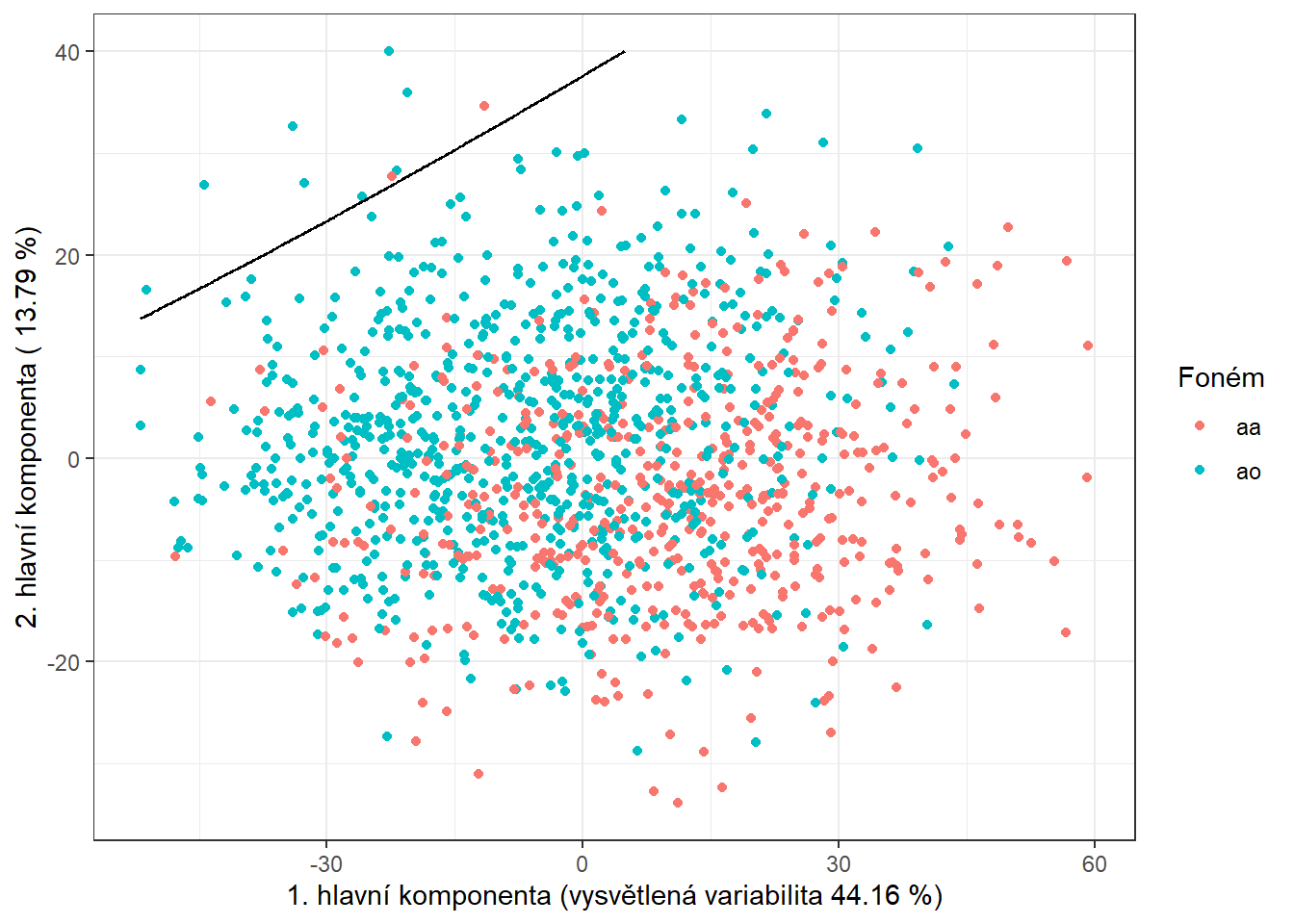

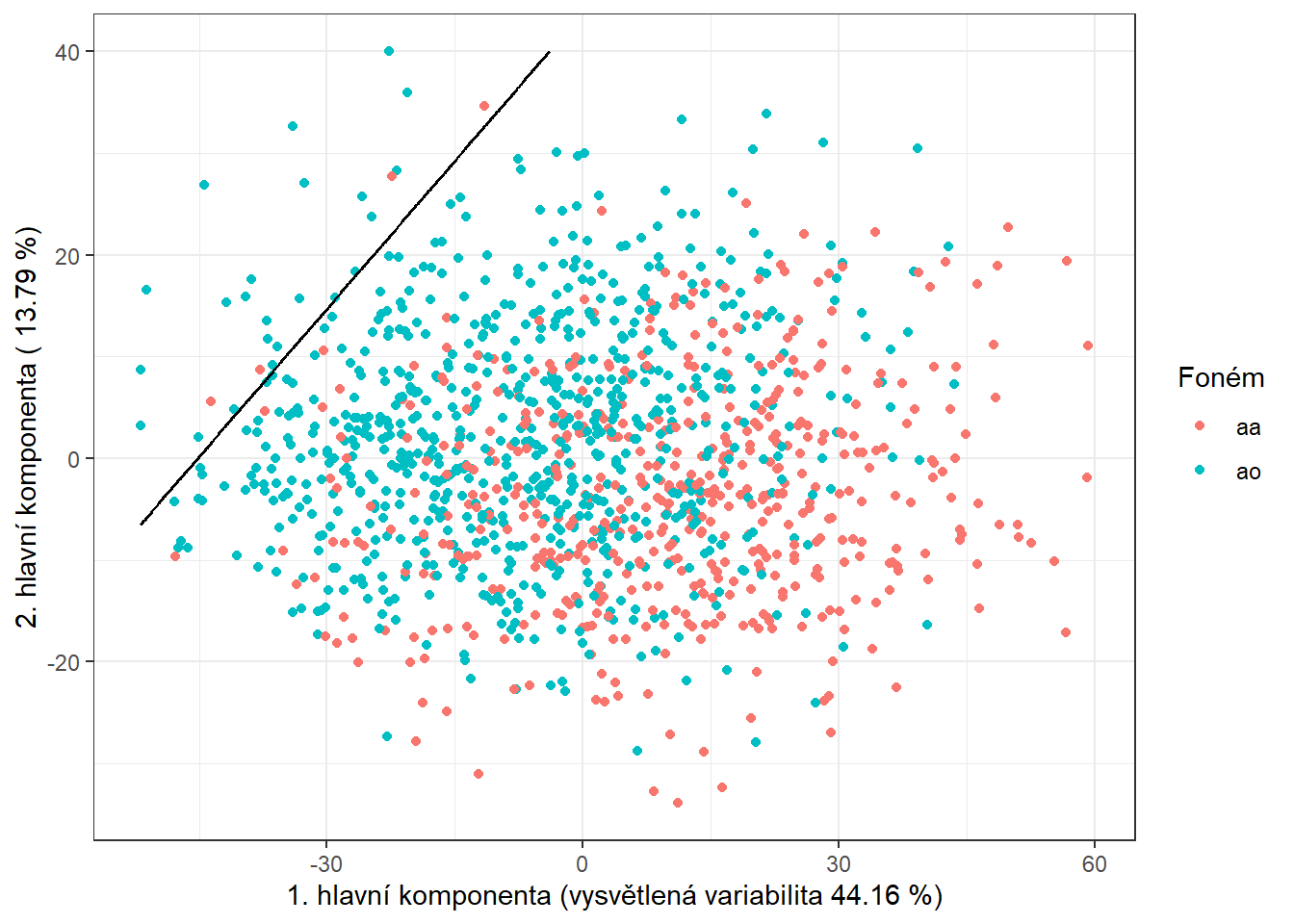

data.PCA.train$Y <- factor(Y.train) # prislusnost do tridV tomto konkrétním případě jsme za počet hlavních komponent vzali \(p\) = 9, které dohromady vysvětlují 90.26 % variability v datech. První hlavní komponenta potom vysvětluje 44.16 % a druhá 13.79 % variability. Graficky si můžeme zobrazit hodnoty skórů prvních dvou hlavních komponent, barevně odlišených podle příslušnosti do klasifikační třídy.

Code

data.PCA.train |> ggplot(aes(x = V1, y = V2, colour = Y)) +

geom_point(size = 1.5) +

labs(x = paste('1. hlavní komponenta (vysvětlená variabilita',

round(100 * data.PCA$varprop[1], 2), '%)'),

y = paste('2. hlavní komponenta (',

round(100 * data.PCA$varprop[2], 2), '%)'),

colour = 'Foném') +

scale_colour_discrete(labels = phoneme_subset) +

theme_bw()

Obrázek 8.1: Hodnoty skórů prvních dvou hlavních komponent pro trénovací data. Barevně jsou odlišeny body podle příslušnosti do klasifikační třídy.

Abychom mohli určit přesnost klasifikace na testovacích datech, potřebujeme spočítat skóre pro první 9 hlavní komponenty pro testovací data. Tato skóre určíme pomocí vzorce:

\[ \xi_{i, j} = \int \left( X_i(t) - \mu(t)\right) \cdot \rho_j(t)\text dt, \] kde \(\mu(t)\) je střední hodnota (průměrná funkce) a \(\rho_j(t)\) vlastní fukce (funkcionální hlavní komponenty).

Code

# vypocet skoru testovacich funkci

scores <- matrix(NA, ncol = nharm, nrow = length(Y.test)) # prazdna matice

for(k in 1:dim(scores)[1]) {

xfd = X.test[k] - data.PCA$meanfd[1] # k-te pozorovani - prumerna funkce

scores[k, ] = inprod(xfd, data.PCA$harmonics)

# skalarni soucin rezidua a vlastnich funkci rho (funkcionalni hlavni komponenty)

}

data.PCA.test <- as.data.frame(scores)

data.PCA.test$Y <- factor(Y.test)

colnames(data.PCA.test) <- colnames(data.PCA.train) Nyní již můžeme sestrojit klasifikátor na trénovací části dat.

Code

# model

clf.LDA <- lda(Y ~ ., data = data.PCA.train)

# presnost na trenovacich datech

predictions.train <- predict(clf.LDA, newdata = data.PCA.train)

presnost.train <- table(data.PCA.train$Y, predictions.train$class) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.LDA, newdata = data.PCA.test)

presnost.test <- table(data.PCA.test$Y, predictions.test$class) |>

prop.table() |> diag() |> sum()Spočítali jsme jednak chybovost klasifikátoru na trénovacích (19.95 %), tak i na testovacích datech (20.96 %).

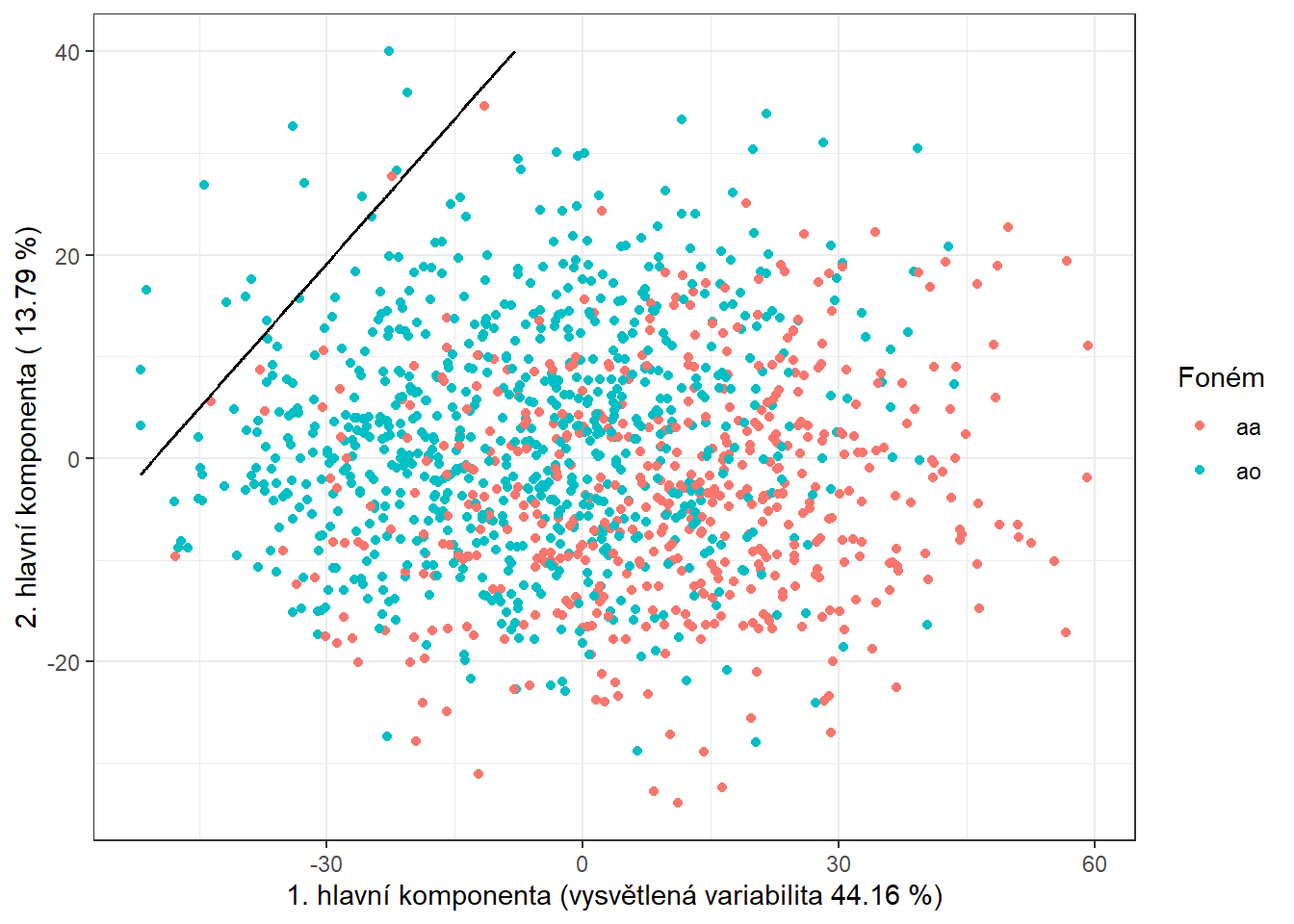

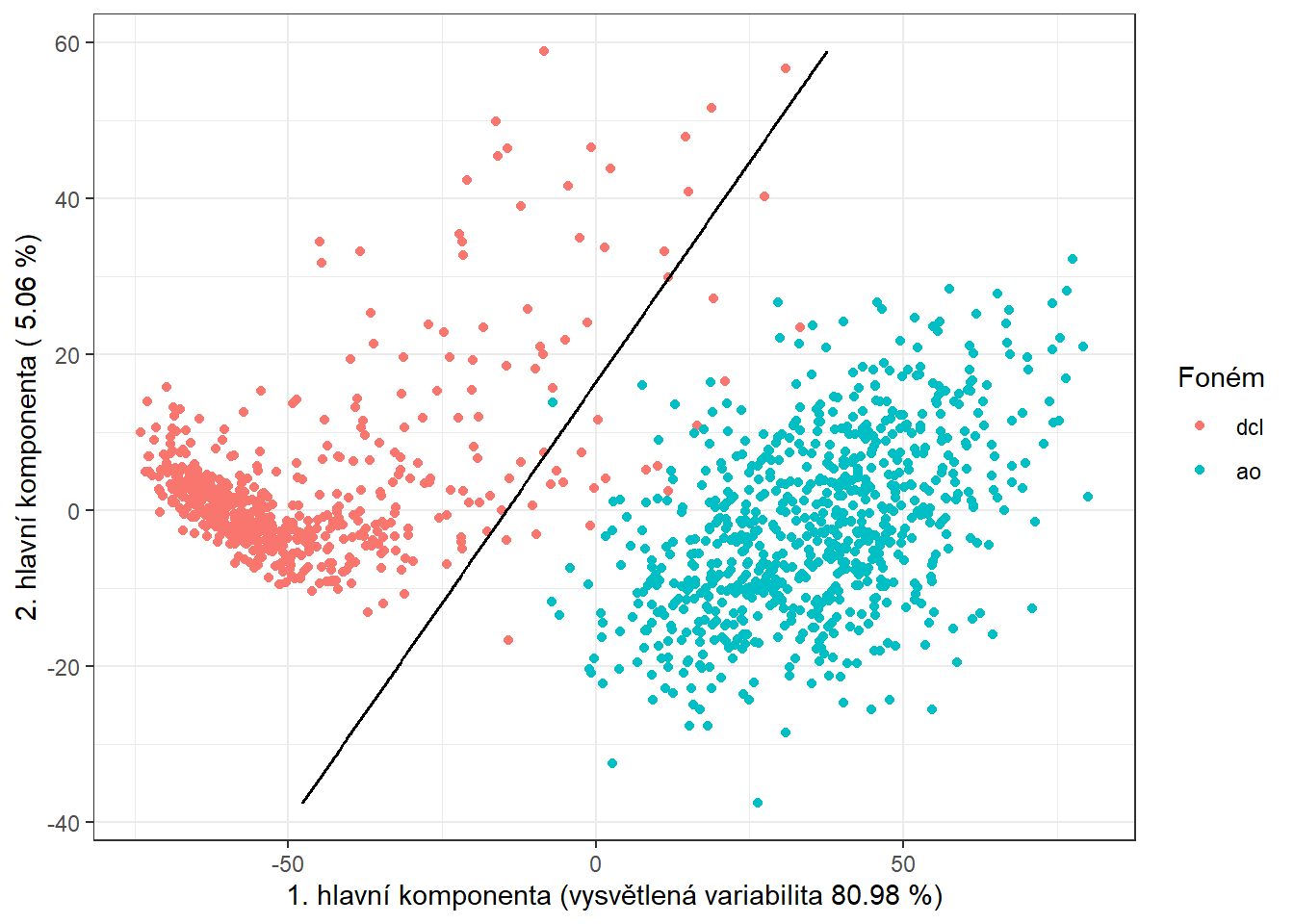

Pro grafické znázornění metody můžeme zaznačit dělící hranici do grafu skórů prvních dvou hlavních komponent.

Tuto hranici spočítáme na husté síti bodů a zobrazíme ji pomocí funkce geom_contour().

Code

# pridame diskriminacni hranici

np <- 1001 # pocet bodu site

# x-ova osa ... 1. HK

nd.x <- seq(from = min(data.PCA.train$V1),

to = max(data.PCA.train$V1), length.out = np)

# y-ova osa ... 2. HK

nd.y <- seq(from = min(data.PCA.train$V2),

to = max(data.PCA.train$V2), length.out = np)

# pripad pro 2 HK ... p = 2

nd <- expand.grid(V1 = nd.x, V2 = nd.y)

# pokud p = 3

if(dim(data.PCA.train)[2] == 4) {

nd <- expand.grid(V1 = nd.x, V2 = nd.y, V3 = data.PCA.train$V3[1])}

# pokud p = 4

if(dim(data.PCA.train)[2] == 5) {

nd <- expand.grid(V1 = nd.x, V2 = nd.y, V3 = data.PCA.train$V3[1],

V4 = data.PCA.train$V4[1])}

# pokud p = 5

if(dim(data.PCA.train)[2] == 6) {

nd <- expand.grid(V1 = nd.x, V2 = nd.y, V3 = data.PCA.train$V3[1],

V4 = data.PCA.train$V4[1], V5 = data.PCA.train$V5[1])}

# pokud p = 9

if(dim(data.PCA.train)[2] == 10) {

nd <- expand.grid(V1 = nd.x, V2 = nd.y, V3 = data.PCA.train$V3[1],

V4 = data.PCA.train$V4[1], V5 = data.PCA.train$V5[1],

V6 = data.PCA.train$V5[1], V7 = data.PCA.train$V5[1],

V8 = data.PCA.train$V5[1], V9 = data.PCA.train$V5[1])}

# pridame Y = 0, 1

nd <- nd |> mutate(prd = as.numeric(predict(clf.LDA, newdata = nd)$class))

data.PCA.train |> ggplot(aes(x = V1, y = V2, colour = Y)) +

geom_point(size = 1.5) +

labs(x = paste('1. hlavní komponenta (vysvětlená variabilita',

round(100 * data.PCA$varprop[1], 2), '%)'),

y = paste('2. hlavní komponenta (',

round(100 * data.PCA$varprop[2], 2), '%)'),

colour = 'Foném') +

scale_colour_discrete(labels = phoneme_subset) +

theme_bw() +

geom_contour(data = nd, aes(x = V1, y = V2, z = prd), colour = 'black')

Obrázek 5.5: Skóre prvních dvou hlavních komponent, barevně odlišené podle příslušnosti do klasifikační třídy. Černě je vyznačena dělící hranice (přímka v rovině prvních dvou hlavních komponent) mezi třídami sestrojená pomocí LDA.

Vidíme, že dělící hranicí je přímka, lineární funkce v prostoru 2D, což jsme ostatně od LDA čekali. Nakonec přidáme chybovosti do souhrnné tabulky.

11.2.3 Kvadratická diskriminační analýza

Jako další sestrojme klasifikátor pomocí kvadratické diskriminační analýzy (QDA). Jedná se o analogický případ jako LDA s tím rozdílem, že nyní připouštíme pro každou ze tříd rozdílnou kovarianční matici normálního rozdělení, ze kterého pocházejí příslušné skóry. Tento vypuštěný předpoklad o rovnosti kovariančních matic vede ke kvadratické hranici mezi třídami.

V R se provede QDA analogicky jako LDA v předchozí části, tedy opět bychom pomocí funkcionální analýzy hlavních komponent spočítali skóre pro trénovací i testovací funkce, sestrojili klasifikátor na skórech prvních \(p\) hlavních komponent a pomocí něj predikovali příslušnost testovacích křivek do třídy \(Y^* \in \{\texttt{aa}, \texttt{ao}\}\).

Funkcionální PCA provádět nemusíme, využijeme výsledků z části LDA.

Můžeme tedy rovnou přistoupit k sestrojení klasifikátoru, což provedeme pomocí funkce qda().

Následně spočítáme přesnost klasifikátoru na testovacích a trénovacích datech.

Code

# model

clf.QDA <- qda(Y ~ ., data = data.PCA.train)

# presnost na trenovacich datech

predictions.train <- predict(clf.QDA, newdata = data.PCA.train)

presnost.train <- table(data.PCA.train$Y, predictions.train$class) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.QDA, newdata = data.PCA.test)

presnost.test <- table(data.PCA.test$Y, predictions.test$class) |>

prop.table() |> diag() |> sum()Spočítali jsme tedy jednak chybovost klasifikátoru na trénovacích (20.19 %), tak i na testovacích datech (20.96 %).

Pro grafické znázornění metody můžeme zaznačit dělící hranici do grafu skórů prvních dvou hlavních komponent.

Tuto hranici spočítáme na husté síti bodů a zobrazíme ji pomocí funkce geom_contour() stejně jako v případě LDA.

Code

nd <- nd |> mutate(prd = as.numeric(predict(clf.QDA, newdata = nd)$class))

data.PCA.train |> ggplot(aes(x = V1, y = V2, colour = Y)) +

geom_point(size = 1.5) +

labs(x = paste('1. hlavní komponenta (vysvětlená variabilita',

round(100 * data.PCA$varprop[1], 2), '%)'),

y = paste('2. hlavní komponenta (',

round(100 * data.PCA$varprop[2], 2), '%)'),

colour = 'Foném') +

scale_colour_discrete(labels = phoneme_subset) +

theme_bw() +

geom_contour(data = nd, aes(x = V1, y = V2, z = prd), colour = 'black')

Obrázek 7.3: Skóre prvních dvou hlavních komponent, barevně odlišené podle příslušnosti do klasifikační třídy. Černě je vyznačena dělící hranice (parabola v rovině prvních dvou hlavních komponent) mezi třídami sestrojená pomocí QDA.

Všimněme si, že dělící hranicí mezi klasifikačními třídami je nyní parabola.

Nakonec ještě doplníme chybovosti do souhrnné tabulky.

11.2.4 Logistická regrese

Logistickou regresi můžeme provést dvěma způsoby. Jednak použít funkcionální obdobu klasické logistické regrese, druhak klasickou mnohorozměrnou logistickou regresi, kterou provedeme na skórech prvních \(p\) hlavních komponent.

11.2.4.1 Funkcionální logistická regrese

Analogicky jako v případě konečné dimenze vstupních dat uvažujeme logistický model ve tvaru:

\[ g\left(\mathbb E [Y|X = x]\right) = \eta (x) = g(\pi(x)) = \alpha + \int \beta(t)\cdot x(t) \text d t, \] kde \(\eta(x)\) je lineární prediktor nabývající hodnot z intervalu \((-\infty, \infty)\), \(g(\cdot)\) je linková funkce, v případě logistické regrese se jedná o logitovou funkci \(g: (0,1) \rightarrow \mathbb R,\ g(p) = \ln\frac{p}{1-p}\) a \(\pi(x)\) podmíněná pravděpodobnost

\[ \pi(x) = \text{Pr}(Y = 1 | X = x) = g^{-1}(\eta(x)) = \frac{\text e^{\alpha + \int \beta(t)\cdot x(t) \text d t}}{1 + \text e^{\alpha + \int \beta(t)\cdot x(t) \text d t}}, \]

přičemž \(\alpha\) je konstanta a \(\beta(t) \in L^2[a, b]\) je parametrická funkce. Naším cílem je odhadnout tuto parametrickou funkci.

Pro funkcionální logistickou regresi použijeme funkci fregre.glm() z balíčku fda.usc.

Nejprve si vytvoříme vhodné objekty pro konstrukci klasifikátoru.

Code

# vytvorime vhodne objekty

x.train <- fdata(X.train)

y.train <- as.numeric(Y.train)

# body, ve kterych jsou funkce vyhodnoceny

tt <- x.train[["argvals"]]

dataf <- as.data.frame(y.train) - 1

colnames(dataf) <- "Y"

# B-spline baze

# potrebujeme zvolit bazi pro funkcionalni pozorovani, klasicky volime

# stejnou bazi jako je ta pouzita pro vyhlazeni krivek. Tato volba vsak

# vede k numericke chybe, zvolime proto bazi s mensim poctem bazovych funkci.

# Po vyzkouseni nekolika moznosti se zda, ze 100 funkci je dostatecne mnoho.

nbasis.x <- 100

basis1 <- create.bspline.basis(rangeval = range(tt), nbasis = nbasis.x)Abychom mohli odhadnout parametrickou funkci \(\beta(t)\), potřebujeme ji vyjádřit v nějaké bazické reprezentaci, v našem případě B-splinové bázi. K tomu však potřebujeme najít vhodný počet bázových funkcí. To bychom mohli určit na základě chybovosti na trénovacích datech, avšak tato data budou upřenostňovat výběr velkého počtu bází a bude docházet k přeučení modelu.

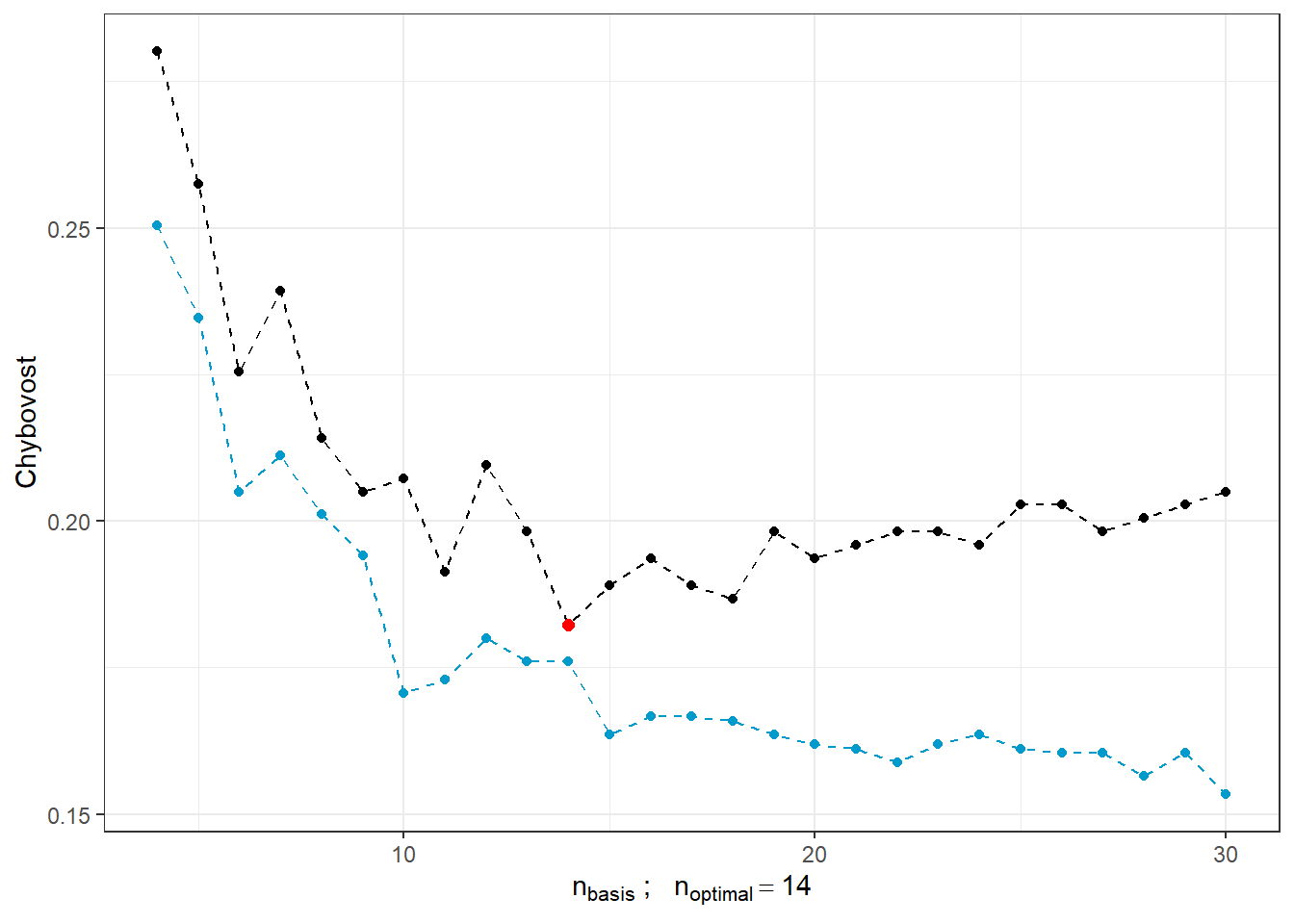

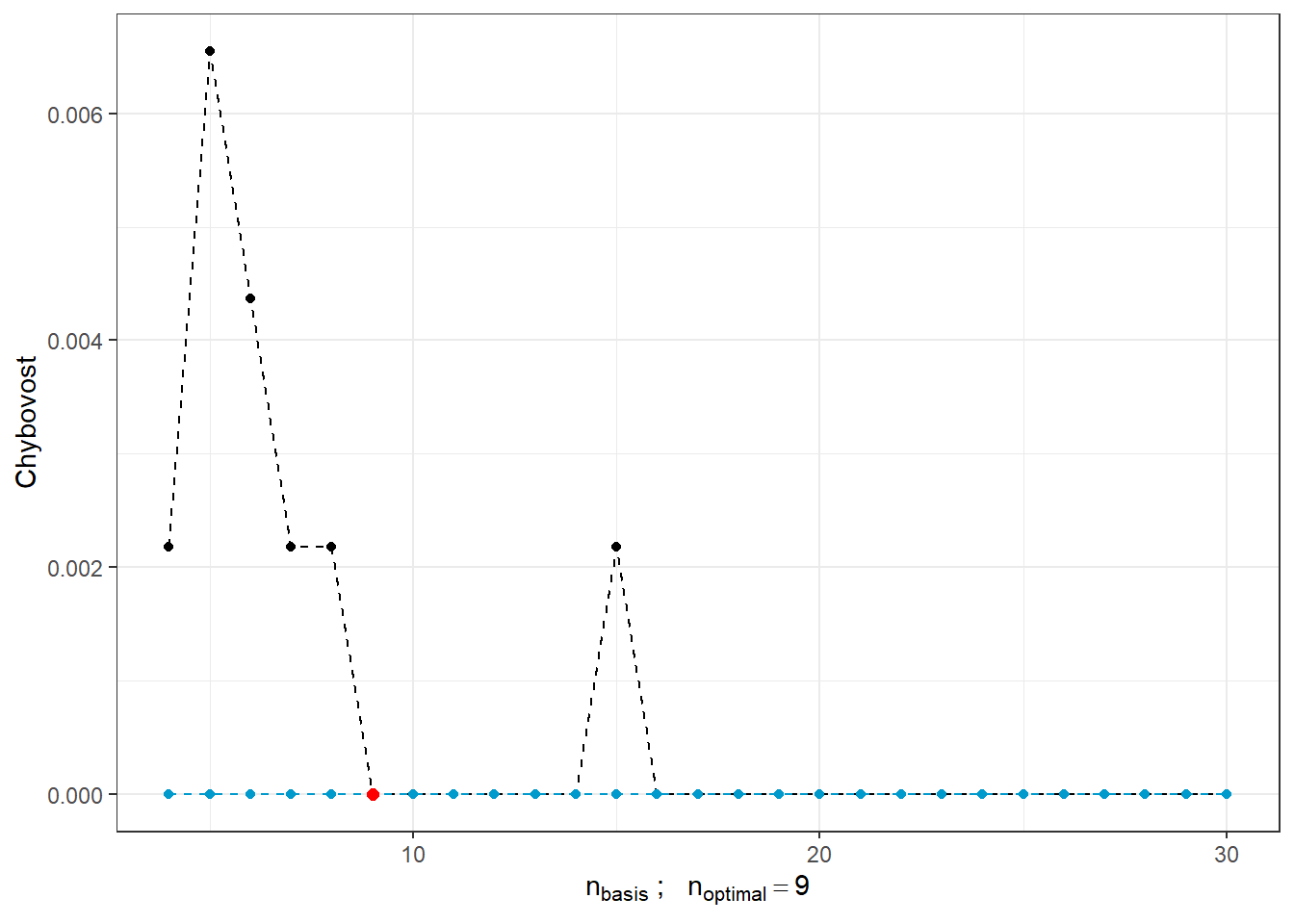

Ilustrujme si to na následujícím případě. Pro každý z počtu bází \(n_{basis} \in \{4, 5, \dots, 30\}\) natrénujeme model na trénovacích datech, určíme na nich chybovost a také spočítáme chybovost na testovacích datech. Připomeňme, že k výběru vhodného počtu bází nemůžeme využít stejná data jako pro odhad testovací chybovosti, neboť bychom tuto chybovost podcenili.

Code

n.basis.max <- 30

n.basis <- 4:n.basis.max

pred.baz <- matrix(NA, nrow = length(n.basis), ncol = 2,

dimnames = list(n.basis, c('Err.train', 'Err.test')))

for (i in n.basis) {

# baze pro bety

basis2 <- create.bspline.basis(rangeval = range(tt), nbasis = i)

# vztah

f <- Y ~ x

# baze pro x a bety

basis.x <- list("x" = basis1) # vyhlazene data

basis.b <- list("x" = basis2)

# vstupni data do modelu

ldata <- list("df" = dataf, "x" = x.train)

# binomicky model ... model logisticke regrese

model.glm <- fregre.glm(f, family = binomial(), data = ldata,

basis.x = basis.x, basis.b = basis.b)

# presnost na trenovacich datech

predictions.train <- predict(model.glm, newx = ldata)

predictions.train <- data.frame(Y.pred = ifelse(predictions.train < 1/2, 0, 1))

presnost.train <- table(Y.train, predictions.train$Y.pred) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

newldata = list("df" = as.data.frame(Y.test), "x" = fdata(X.test))

predictions.test <- predict(model.glm, newx = newldata)

predictions.test <- data.frame(Y.pred = ifelse(predictions.test < 1/2, 0, 1))

presnost.test <- table(Y.test, predictions.test$Y.pred) |>

prop.table() |> diag() |> sum()

# vlozime do matice

pred.baz[as.character(i), ] <- 1 - c(presnost.train, presnost.test)

}

pred.baz <- as.data.frame(pred.baz)

pred.baz$n.basis <- n.basisZnázorněme si průběh obou typů chybovostí v grafu v závislosti na počtu bazických funkcí.

Code

n.basis.beta.opt <- pred.baz$n.basis[which.min(pred.baz$Err.test)]

pred.baz |> ggplot(aes(x = n.basis, y = Err.test)) +

geom_line(linetype = 'dashed', colour = 'black') +

geom_line(aes(x = n.basis, y = Err.train), colour = 'deepskyblue3',

linetype = 'dashed', linewidth = 0.5) +

geom_point(size = 1.5) +

geom_point(aes(x = n.basis, y = Err.train), colour = 'deepskyblue3',

size = 1.5) +

geom_point(aes(x = n.basis.beta.opt, y = min(pred.baz$Err.test)),

colour = 'red', size = 2) +

theme_bw() +

labs(x = bquote(paste(n[basis], ' ; ',

n[optimal] == .(n.basis.beta.opt))),

y = 'Chybovost')

Obrázek 10.2: Závislost testovací a trénovací chybovosti na počtu bázových funkcí pro \(\beta\). Červeným bodem je znázorněn optimální počet \(n_{optimal}\) zvolený jako minimum testovací chybovosti, černou čarou je vykreslena testovací a modrou přerušovanou čarou je vykreslen průběh trénovací chybovosti.

Vidíme, že s rostoucím počtem bází pro \(\beta(t)\) má trénovací chybovost (modrá čára) tendenci klesat a tedy bychom na jejím základě volili velké hodnoty \(n_{basis}\). Naopak optimální volbou na základě testovací chybovosti je \(n\) rovno 14, tedy výrazně menší hodnota než 30. Naopak s rostoucím \(n\) roste testovací chyvost, což ukazuje na přeučení modelu.

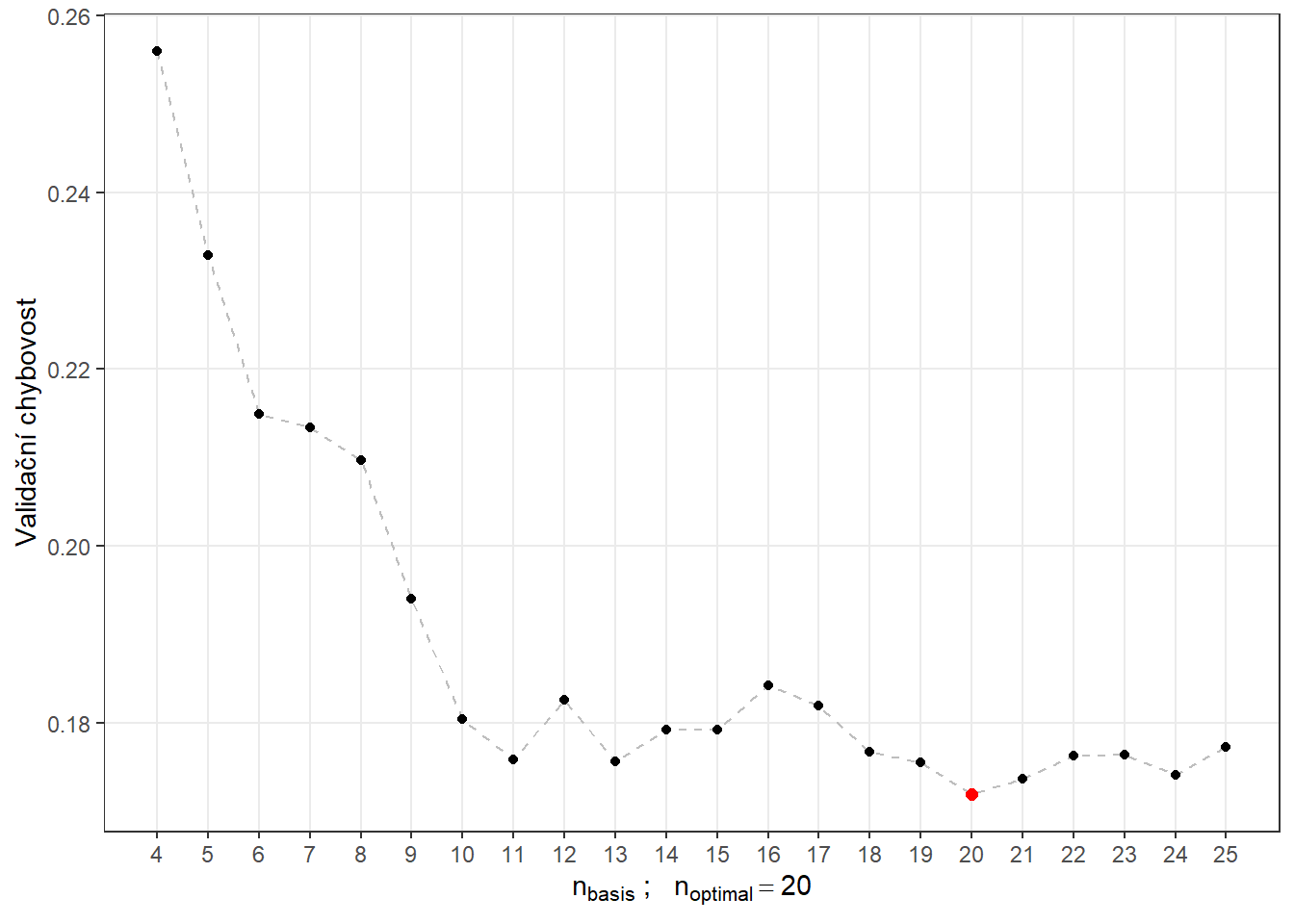

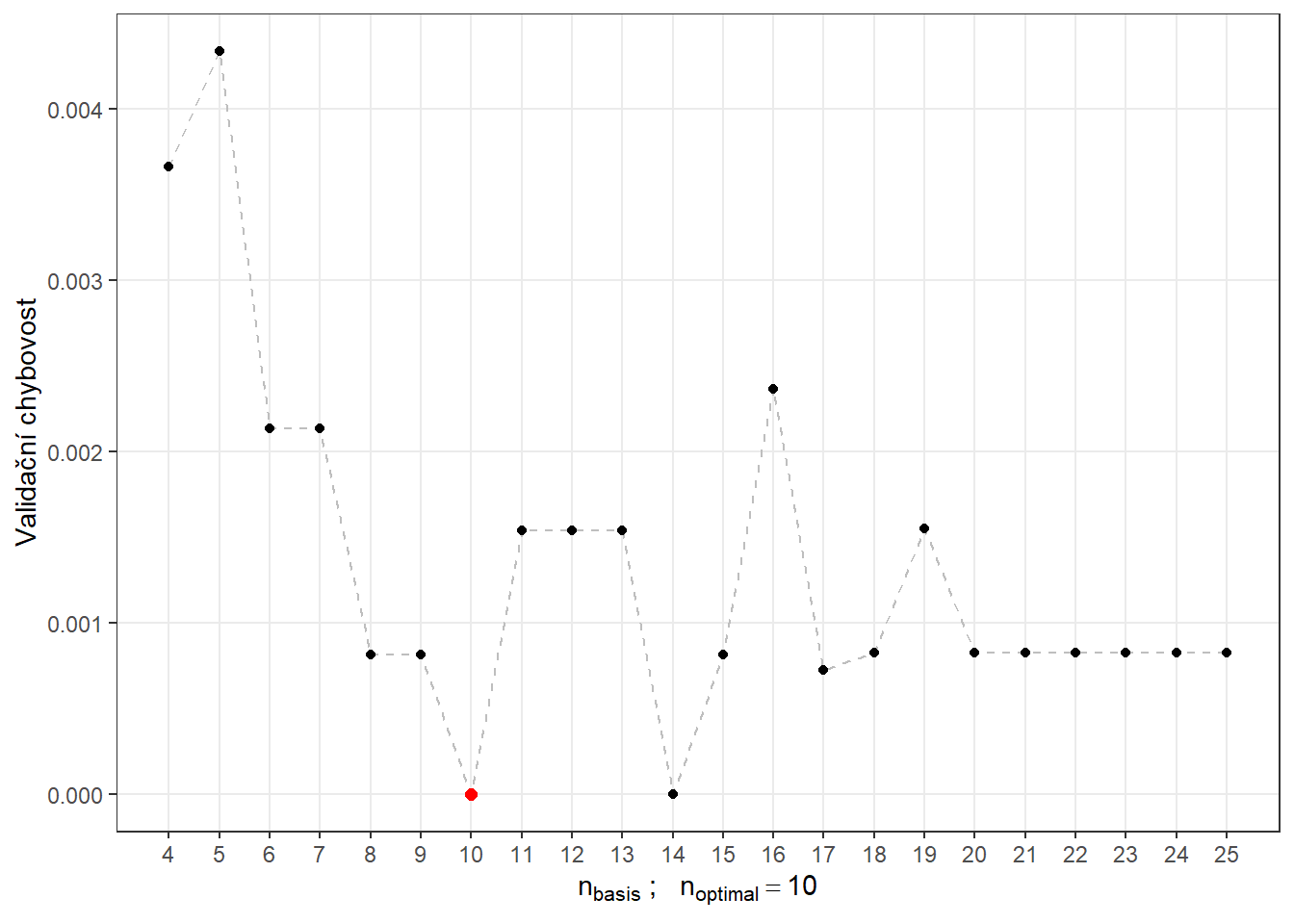

Z výše uvedených důvodů pro určení optimálního počtu bazických funkcí pro \(\beta(t)\) využijeme 10-ti násobnou cross-validaci. Jako maximální počet uvažovaných bazických funkcí bereme 25, neboť jak jsme viděli výše, nad touto hodnotou dochází již k přeučení modelu.

Code

### 10-fold cross-validation

n.basis.max <- 25

n.basis <- 4:n.basis.max

k_cv <- 10 # k-fold CV

# rozdelime trenovaci data na k casti

folds <- createMultiFolds(X.train$fdnames$reps, k = k_cv, time = 1)

## prvky, ktere se behem cyklu nemeni

# body, ve kterych jsou funkce vyhodnoceny

tt <- x.train[["argvals"]]

rangeval <- range(tt)

# B-spline baze

basis1 <- create.bspline.basis(rangeval = range(tt), nbasis = nbasis.x)

# vztah

f <- Y ~ x

# baze pro x

basis.x <- list("x" = basis1)

# prazdna matice, do ktere vlozime jednotlive vysledky

# ve sloupcich budou hodnoty presnosti pro danou cast trenovaci mnoziny

# v radcich budou hodnoty pro dany pocet bazi

CV.results <- matrix(NA, nrow = length(n.basis), ncol = k_cv,

dimnames = list(n.basis, 1:k_cv))Nyní již máme vše připravené pro spočítání chybovosti na každé z deseti podmnožin trénovací množiny. Následně určíme průměr a jako optimální \(n\) vezmeme argument minima validační chybovosti.

Code

for (index in 1:k_cv) {

# definujeme danou indexovou mnozinu

fold <- folds[[index]]

x.train.cv <- subset(X.train, c(1:length(X.train$fdnames$reps)) %in% fold) |>

fdata()

y.train.cv <- subset(Y.train, c(1:length(X.train$fdnames$reps)) %in% fold) |>

as.numeric() - 1

x.test.cv <- subset(X.train, !c(1:length(X.train$fdnames$reps)) %in% fold) |>

fdata()

y.test.cv <- subset(Y.train, !c(1:length(X.train$fdnames$reps)) %in% fold) |>

as.numeric() - 1

dataf <- as.data.frame(y.train.cv)

colnames(dataf) <- "Y"

for (i in n.basis) {

# baze pro bety

basis2 <- create.bspline.basis(rangeval = rangeval, nbasis = i)

basis.b <- list("x" = basis2)

# vstupni data do modelu

ldata <- list("df" = dataf, "x" = x.train.cv)

# binomicky model ... model logisticke regrese

model.glm <- fregre.glm(f, family = binomial(), data = ldata,

basis.x = basis.x, basis.b = basis.b)

# presnost na validacni casti

newldata = list("df" = as.data.frame(y.test.cv), "x" = x.test.cv)

predictions.valid <- predict(model.glm, newx = newldata)

predictions.valid <- data.frame(Y.pred = ifelse(predictions.valid < 1/2, 0, 1))

presnost.valid <- table(y.test.cv, predictions.valid$Y.pred) |>

prop.table() |> diag() |> sum()

# vlozime do matice

CV.results[as.character(i), as.character(index)] <- presnost.valid

}

}

# spocitame prumerne presnosti pro jednotliva n pres folds

CV.results <- apply(CV.results, 1, mean)

n.basis.opt <- n.basis[which.max(CV.results)]

presnost.opt.cv <- max(CV.results)Vykresleme si ještě průběh validační chybovosti i se zvýrazněnou optimální hodnotou \(n_{optimal}\) rovnou 20 s validační chybovostí 0.1719.

Code

CV.results <- data.frame(n.basis = n.basis, CV = CV.results)

CV.results |> ggplot(aes(x = n.basis, y = 1 - CV)) +

geom_line(linetype = 'dashed', colour = 'grey') +

geom_point(size = 1.5) +

geom_point(aes(x = n.basis.opt, y = 1 - presnost.opt.cv), colour = 'red', size = 2) +

theme_bw() +

labs(x = bquote(paste(n[basis], ' ; ',

n[optimal] == .(n.basis.opt))),

y = 'Validační chybovost') +

scale_x_continuous(breaks = n.basis) +

theme(panel.grid.minor = element_blank())

Obrázek 5.7: Závislost validační chybovosti na hodnotě \(n_{basis}\), tedy na počtu bází.

Nyní již tedy můžeme definovat finální model pomocí funkcionální logistické regrese, přičemž bázi pro \(\beta(t)\) volíme B-splinovou bázi s 20 bázemi.

Code

# optimalni model

basis2 <- create.bspline.basis(rangeval = range(tt), nbasis = n.basis.opt)

f <- Y ~ x

# baze pro x a bety

basis.x <- list("x" = basis1)

basis.b <- list("x" = basis2)

# vstupni data do modelu

dataf <- as.data.frame(y.train - 1)

colnames(dataf) <- "Y"

ldata <- list("df" = dataf, "x" = x.train)

# binomicky model ... model logisticke regrese

model.glm <- fregre.glm(f, family = binomial(), data = ldata,

basis.x = basis.x, basis.b = basis.b)

# presnost na trenovacich datech

predictions.train <- predict(model.glm, newx = ldata)

predictions.train <- data.frame(Y.pred = ifelse(predictions.train < 1/2, 0, 1))

presnost.train <- table(Y.train, predictions.train$Y.pred) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

newldata = list("df" = as.data.frame(Y.test), "x" = fdata(X.test))

predictions.test <- predict(model.glm, newx = newldata)

predictions.test <- data.frame(Y.pred = ifelse(predictions.test < 1/2, 0, 1))

presnost.test <- table(Y.test, predictions.test$Y.pred) |>

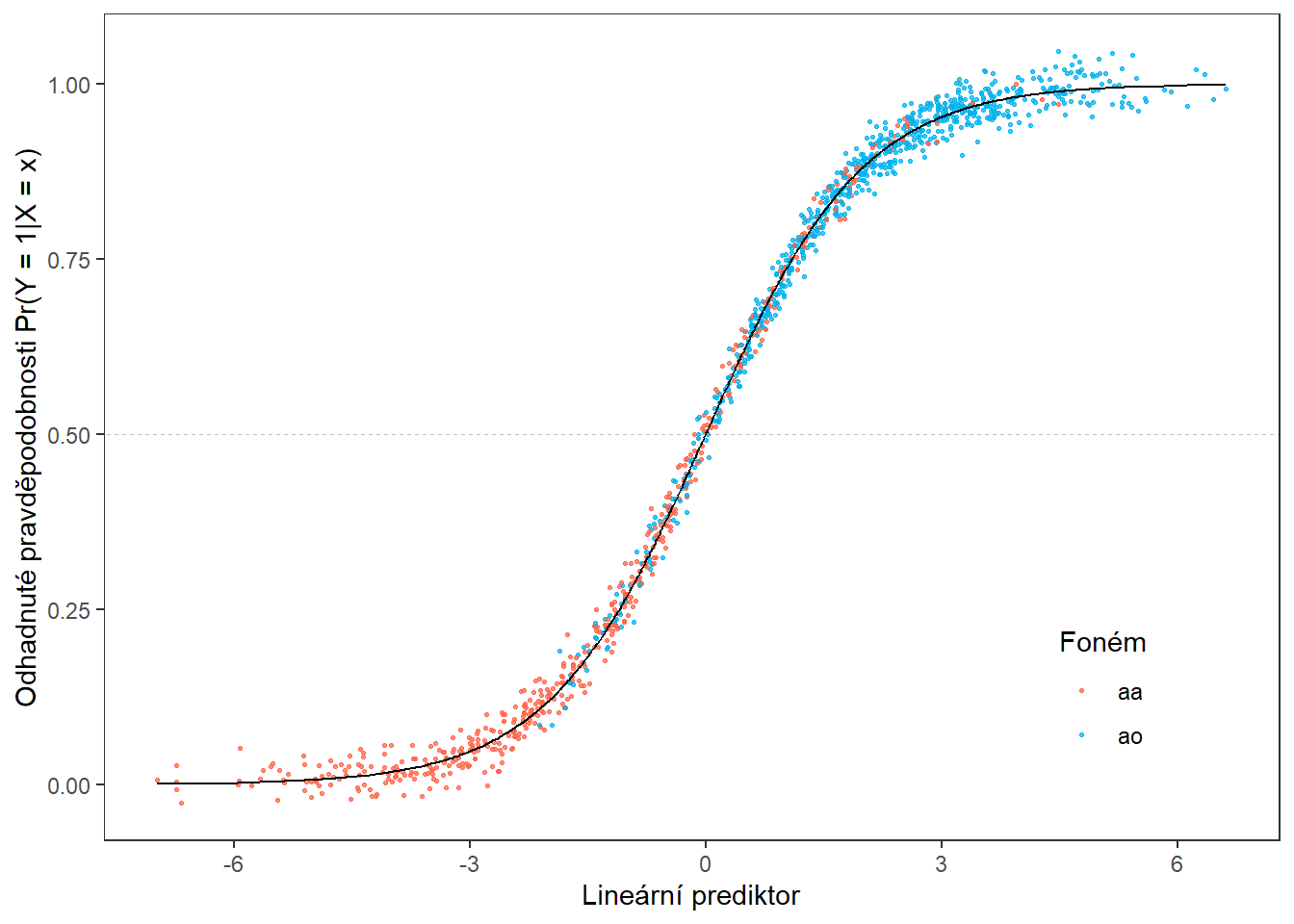

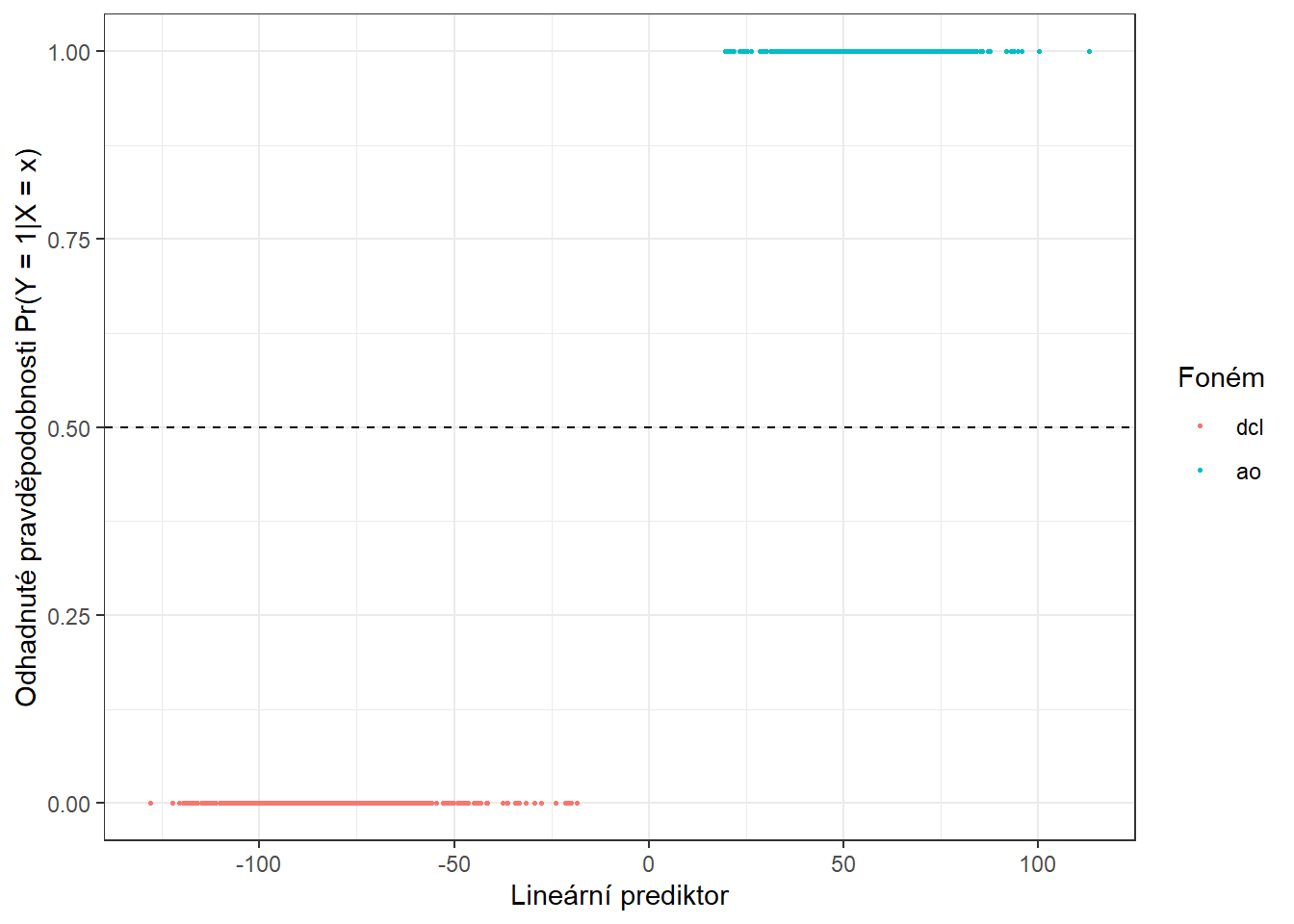

prop.table() |> diag() |> sum()Spočítali jsme trénovací chybovost (rovna 16.2 %) i testovací chybovost (rovna 19.36 %). Pro lepší představu si ještě můžeme vykreslit hodnoty odhadnutých pravděpodobností příslušnosti do klasifikační třídy \(Y = 1\) na trénovacích datech v závislosti na hodnotách lineárního prediktoru.

Code

data.frame(

linear.predictor = model.glm$linear.predictors,

response = model.glm$fitted.values,

Y = factor(y.train)

) |> ggplot(aes(x = linear.predictor, y = response, colour = Y)) +

geom_abline(aes(slope = 0, intercept = 0.5), linetype = 'dashed', colour = 'grey', linewidth = 0.3) +

geom_point(aes(x = linear.predictor,

y = response + rnorm(length(response), sd = 0.02),

colour = Y),

size = 0.5, alpha = 0.75) +

geom_line(aes(x = linear.predictor, y = response), colour = 'grey2') +

# scale_colour_discrete(labels = phoneme_subset) +

theme_bw() +

labs(x = 'Lineární prediktor',

y = 'Odhadnuté pravděpodobnosti Pr(Y = 1|X = x)',

colour = 'Foném') +

scale_colour_manual(values = c('tomato', 'deepskyblue2'),

labels = phoneme_subset) +

theme(panel.grid.major = element_blank(),

panel.grid.minor = element_blank(),

legend.position = c(0.85, 0.18)) +

scale_y_continuous(breaks = c(0, 0.25, 0.5, 0.75, 1)#,

# labels = c('0', '0.25', '0.5', '0.75', '1')

) +

scale_x_continuous(breaks = c(-6, -3, 0, 3, 6))

Obrázek 1.13: Závislost odhadnutých pravděpodobností na hodnotách lineárního prediktoru. Barevně jsou odlišeny body podle příslušnosti do klasifikační třídy.

Code

Můžeme si ještě pro informaci zobrazit průběh odhadnuté parametrické funkce \(\beta(t)\).

Code

t.seq <- seq(min(tt), max(tt), length = 1001)

beta.seq <- eval.fd(evalarg = t.seq, fdobj = model.glm$beta.l$x)

data.frame(t = t.seq, beta = beta.seq) |>

ggplot(aes(t, beta)) +

geom_abline(aes(slope = 0, intercept = 0), linetype = 'dashed',

linewidth = 0.5, colour = 'grey') +

geom_line(colour = 'deepskyblue2', linewidth = 0.8) +

theme_bw() +

labs(x = expression(t),

y = expression(widehat(beta)(t))) +

theme(panel.grid.major = element_blank(),

panel.grid.minor = element_blank())![Průběh odhadu parametrické funkce $\beta(t), t \in [1, 256]$.](11-Application_2_files/figure-html/unnamed-chunk-42-1.png)

Obrázek 7.4: Průběh odhadu parametrické funkce \(\beta(t), t \in [1, 256]\).

Vidíme, že hodnoty funkce \(\hat\beta(t)\) se drží kolem nuly pro frekvence \(t\) z prostředka a konce intervalu \([1, 256]\), zatímco pro počáteční frekvence jsou hodnoty vyšší. To implikuje rozdílnost funkcí z klasifikačních tříd zejména na začátku intervalu, zatímco uprostřed intervalu jsou funkce velmi podobné.

Výsledky opět přidáme do souhrnné tabulky.

11.2.4.2 Logistická regrese s analýzou hlavních komponent

Abychom mohli sesrojit tento klasifikátor, potřebujeme provést funkcionální analýzu hlavních komponent, určit vhodný počet komponent a spočítat hodnoty skórů pro testovací data. To jsme již provedli v části u lineární diskriminační analýzy, proto využijeme tyto výsledky v následující části.

Můžeme tedy rovnou sestrojit model logistické regrese pomocí funkce glm(, family = binomial).

Code

# model

clf.LR <- glm(Y ~ ., data = data.PCA.train, family = binomial)

# presnost na trenovacich datech

predictions.train <- predict(clf.LR, newdata = data.PCA.train, type = 'response')

predictions.train <- ifelse(predictions.train > 0.5, 1, 0)

presnost.train <- table(data.PCA.train$Y, predictions.train) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.LR, newdata = data.PCA.test, type = 'response')

predictions.test <- ifelse(predictions.test > 0.5, 1, 0)

presnost.test <- table(data.PCA.test$Y, predictions.test) |>

prop.table() |> diag() |> sum()Spočítali jsme tedy chybovost klasifikátoru na trénovacích (20.03 %) i na testovacích datech (21.18 %).

Pro grafické znázornění metody můžeme zaznačit dělící hranici do grafu skórů prvních dvou hlavních komponent.

Tuto hranici spočítáme na husté síti bodů a zobrazíme ji pomocí funkce geom_contour() stejně jako v případě LDA i QDA.

Code

nd <- nd |> mutate(prd = as.numeric(predict(clf.LR, newdata = nd,

type = 'response')))

nd$prd <- ifelse(nd$prd > 0.5, 1, 0)

data.PCA.train |> ggplot(aes(x = V1, y = V2, colour = Y)) +

geom_point(size = 1.5) +

labs(x = paste('1. hlavní komponenta (vysvětlená variabilita',

round(100 * data.PCA$varprop[1], 2), '%)'),

y = paste('2. hlavní komponenta (',

round(100 * data.PCA$varprop[2], 2), '%)'),

colour = 'Foném') +

scale_colour_discrete(labels = phoneme_subset) +

theme_bw() +

geom_contour(data = nd, aes(x = V1, y = V2, z = prd), colour = 'black')

Obrázek 1.14: Skóre prvních dvou hlavních komponent, barevně odlišené podle příslušnosti do klasifikační třídy. Černě je vyznačena dělící hranice (přímka v rovině prvních dvou hlavních komponent) mezi třídami sestrojená pomocí logistické regrese.

Všimněme si, že dělící hranicí mezi klasifikačními třídami je nyní přímka jako v případě LDA.

Nakonec ještě doplníme chybovosti do souhrnné tabulky.

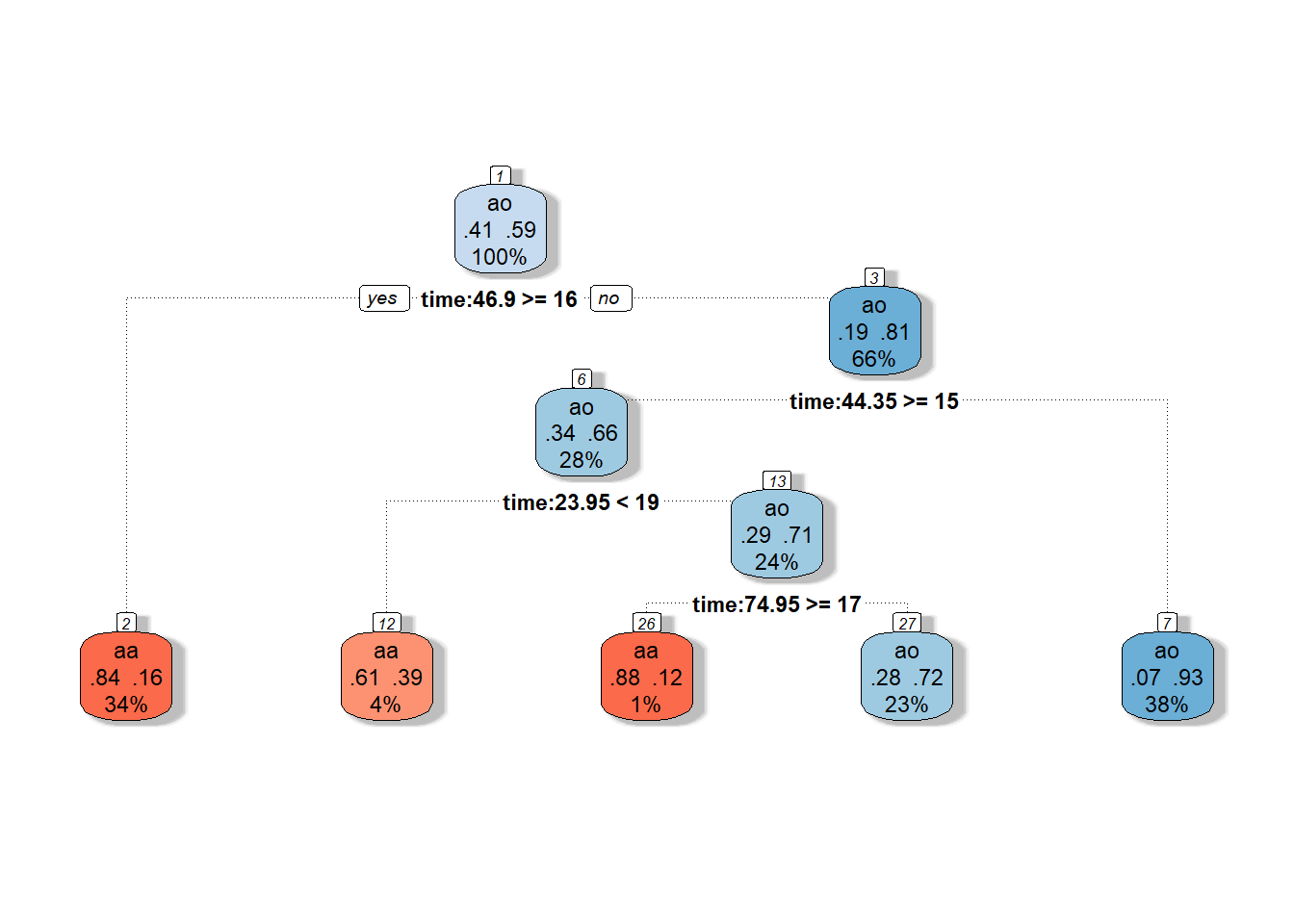

11.2.5 Rozhodovací stromy

V této části se podíváme na velmi odlišný přístup k sestrojení klasifikátoru, než byly například LDA či logistická regrese. Rozhodovací stromy jsou velmi oblíbeným nástrojem ke klasifikaci, avšak jako v případě některých předchozích metod nejsou přímo určeny pro funkcionální data. Existují však postupy, jak funkcionální objekty převést na mnohorozměrné a následně na ně aplikovat algoritmus rozhodovacích stromů. Můžeme uvažovat následující postupy:

algoritmus sestrojený na bázových koeficientech,

využití skórů hlavních komponent,

použít diskretizaci intervalu a vyhodnotit funkci jen na nějaké konečné síti bodů.

My se nejprve zaměříme na diskretizaci intervalu a následně porovnáme výsledky se zbylými dvěma přístupy k sestrojení rozhodovacího stromu.

11.2.5.1 Diskretizace intervalu

Nejprve si musíme definovat body z intervalu \(I = [1, 256]\), ve kterých funkce vyhodnotíme. Následně vytvoříme objekt, ve kterém budou řádky představovat jednotlivé (diskretizované) funkce a sloupce časy. Nakonec připojíme sloupec \(Y\) s informací o příslušnosti do klasifikační třídy a totéž zopakujeme i pro testovací data.

Code

# posloupnost bodu, ve kterych funkce vyhodnotime

t.seq <- seq(1, 256, length = 101)

grid.data <- eval.fd(fdobj = X.train, evalarg = t.seq)

grid.data <- as.data.frame(t(grid.data)) # transpozice kvuli funkcim v radku

grid.data$Y <- Y.train |> factor()

grid.data.test <- eval.fd(fdobj = X.test, evalarg = t.seq)

grid.data.test <- as.data.frame(t(grid.data.test))

grid.data.test$Y <- Y.test |> factor()Nyní mážeme sestrojit rozhodovací strom, ve kterém budou jakožto prediktory vystupovat všechny časy z vektoru t.seq.

Tato klasifikační metoda není náchylná na multikolinearitu, tudíž se jí nemusíme zabývat.

Jako metriku zvolíme přesnost.

Code

# sestrojeni modelu

clf.tree <- train(Y ~ ., data = grid.data,

method = "rpart",

trControl = trainControl(method = "CV", number = 10),

metric = "Accuracy")

# presnost na trenovacich datech

predictions.train <- predict(clf.tree, newdata = grid.data)

presnost.train <- table(Y.train, predictions.train) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.tree, newdata = grid.data.test)

presnost.test <- table(Y.test, predictions.test) |>

prop.table() |> diag() |> sum()Chybovost klasifikátoru na testovacích datech je tedy 21.41 % a na trénovacích datech 17.76 %.

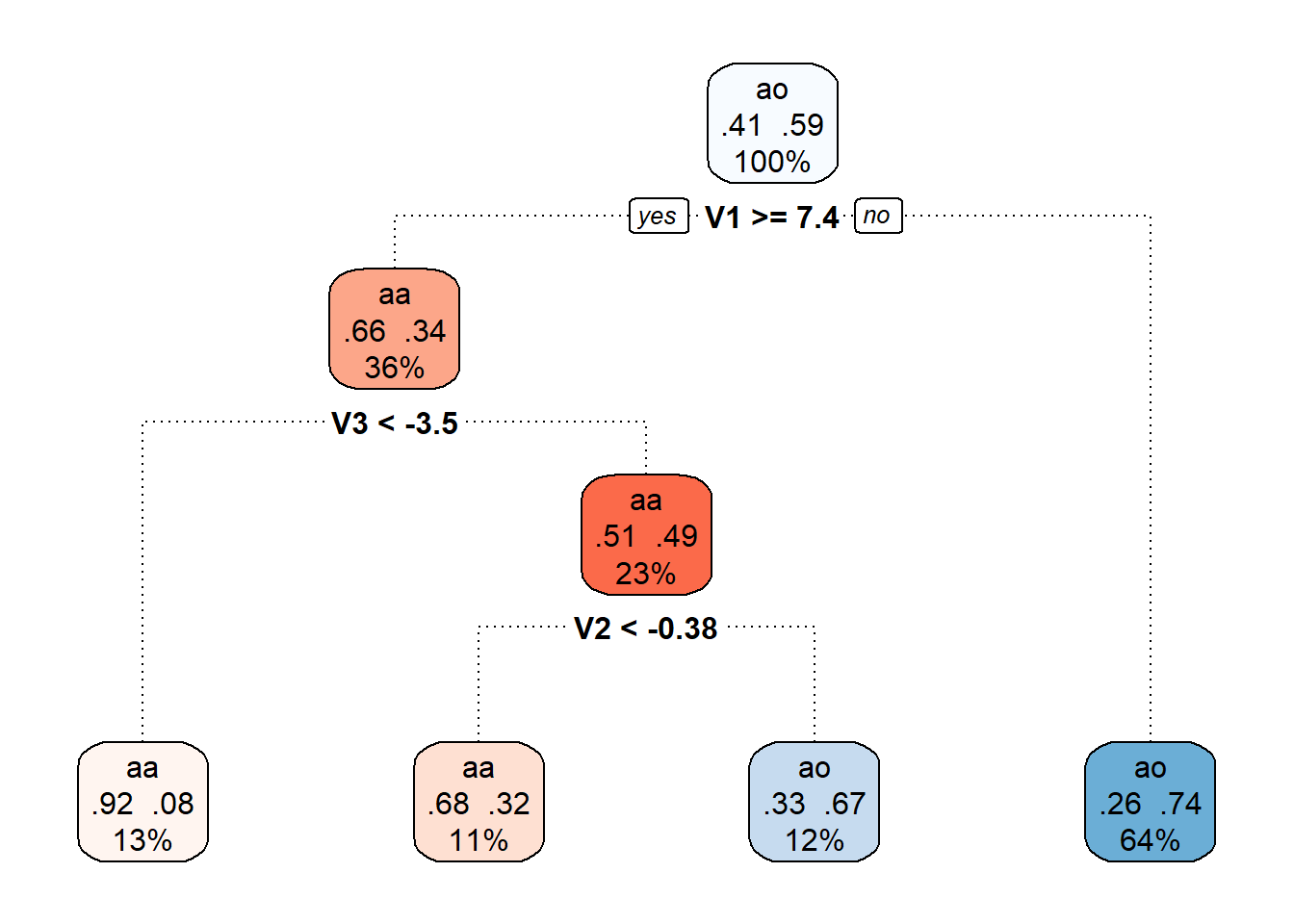

Graficky si rozhodovací strom můžeme vykreslit pomocí funkce fancyRpartPlot().

Nastavíme barvy uzlů tak, aby reflektovaly předchozí barevné odlišení.

Jedná se o neprořezaný strom.

Code

Obrázek 1.15: Grafické znázornění neprořezaného rozhodovacího stromu. Modrými odstíny jsou vykresleny uzly příslušející klasifikační třídě 1 a červenými odstíny třídě 0.

Můžeme si také vykreslit již prořezaný finální rozhodovací strom.

Code

Obrázek 1.16: Finální prořezaný rozhodovací strom.

Nakonec opět přidejme trénovací a testovací chybovost do souhrnné tabulky.

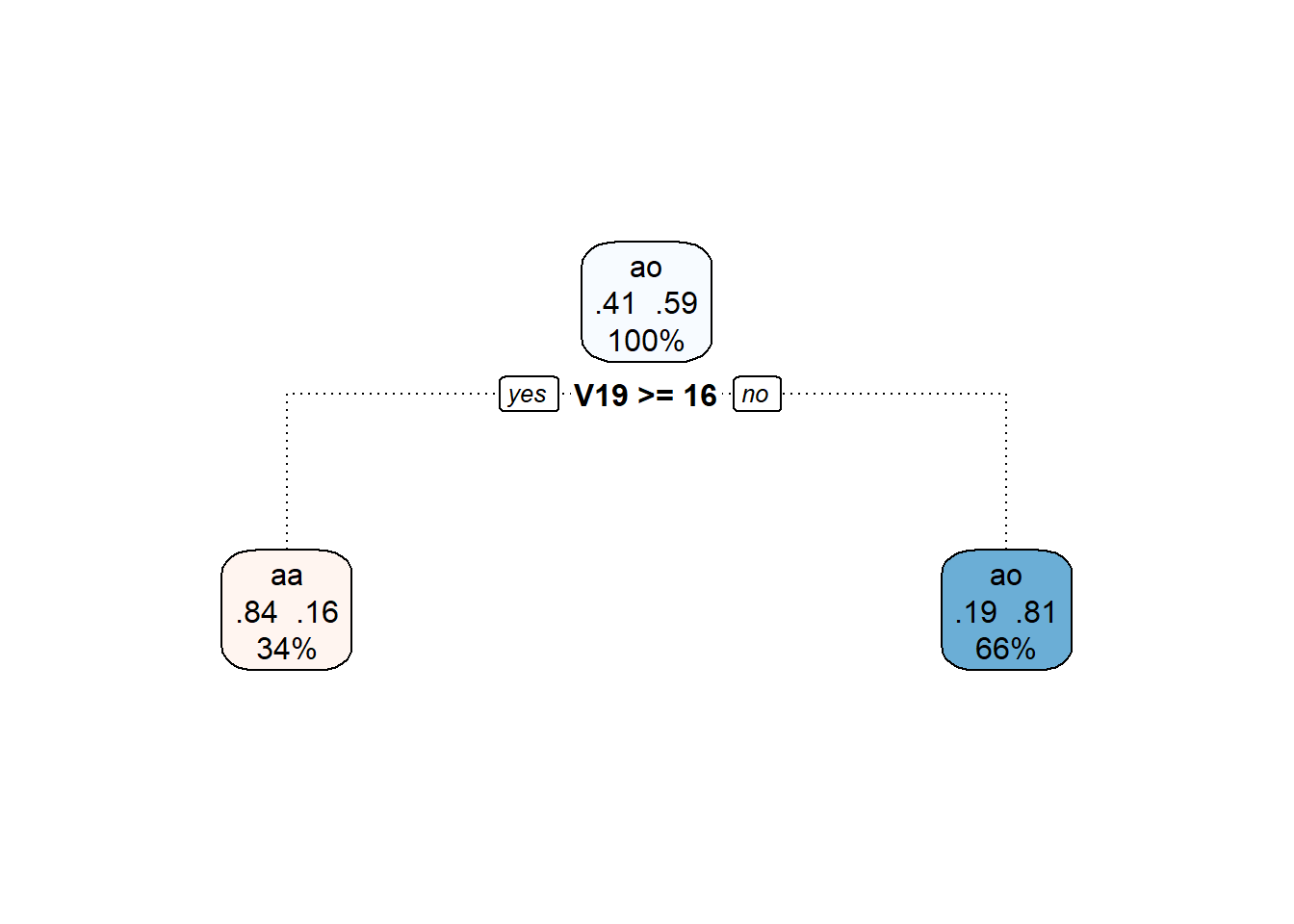

11.2.5.2 Skóre hlavních komponent

Další možností pro sestrojení rozhodovacího stromu je použít skóre hlavních komponent. Jelikož jsme již skóre počítali pro předchozí klasifikační metody, využijeme těchto poznatků a sestrojíme rozhodovací strom na skórech prvních 9 hlavních komponent.

Code

# sestrojeni modelu

clf.tree.PCA <- train(Y ~ ., data = data.PCA.train,

method = "rpart",

trControl = trainControl(method = "CV", number = 10),

metric = "Accuracy")

# presnost na trenovacich datech

predictions.train <- predict(clf.tree.PCA, newdata = data.PCA.train)

presnost.train <- table(Y.train, predictions.train) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.tree.PCA, newdata = data.PCA.test)

presnost.test <- table(Y.test, predictions.test) |>

prop.table() |> diag() |> sum()Chybovost rozhodovacího stromu na testovacích datech je tedy 31.21 % a na trénovacích datech 25.27 %.

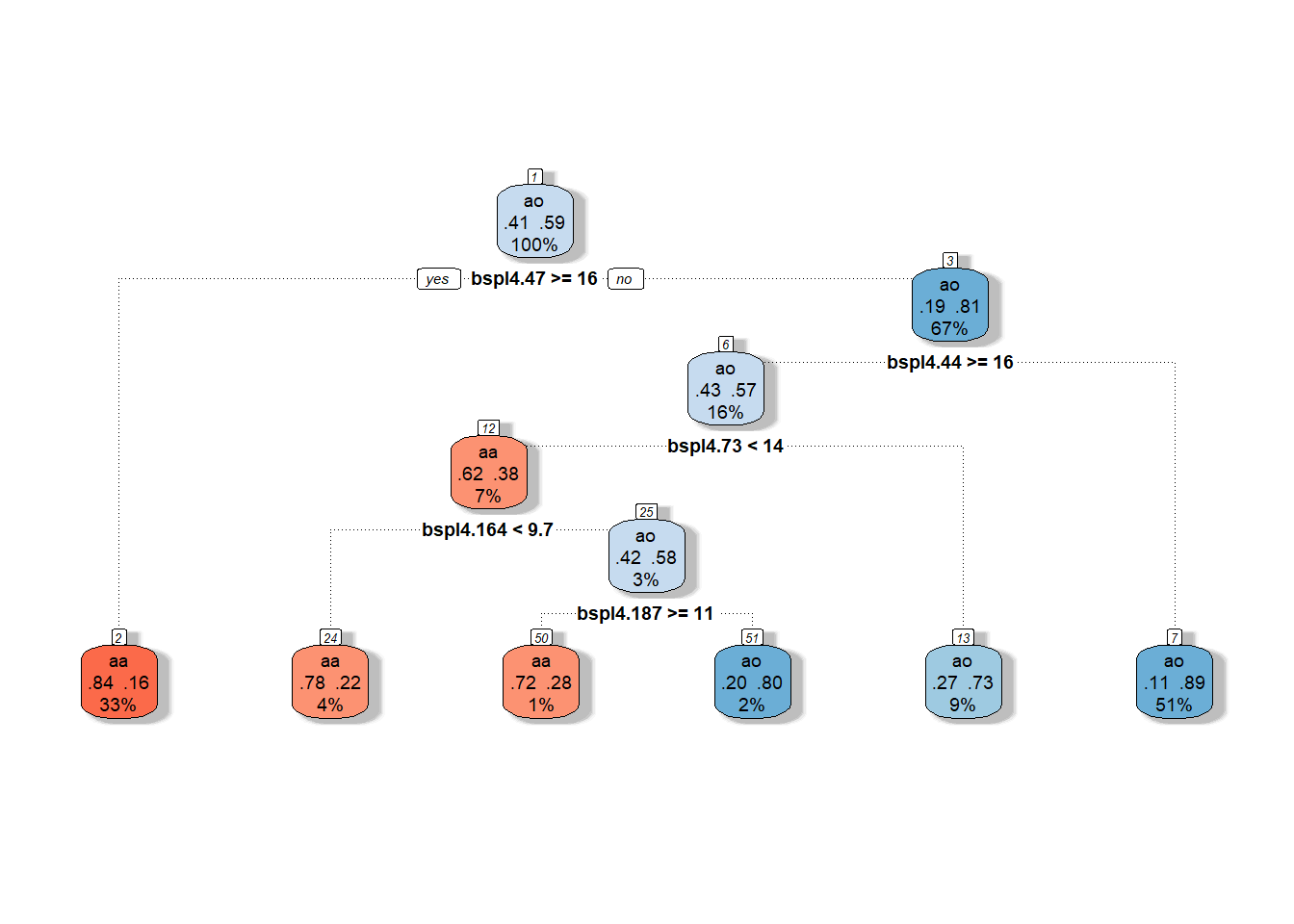

Graficky si rozhodovací strom sestrojený na skórech hlavních komponent můžeme vykreslit pomocí funkce fancyRpartPlot().

Nastavíme barvy uzlů tak, aby reflektovaly předchozí barevné odlišení.

Jedná se o neprořezaný strom.

Code

Obrázek 1.17: Grafické znázornění neprořezaného rozhodovacího stromu sestrojeného na skórech hlavních komponent. Modrými odstíny jsou vykresleny uzly příslušející klasifikační třídě 1 a červenými odstíny třídě 0.

Můžeme si také vykreslit již prořezaný finální rozhodovací strom.

Code

Obrázek 1.18: Finální prořezaný rozhodovací strom.

Nakonec opět přidejme trénovací a testovací chybovost do souhrnné tabulky.

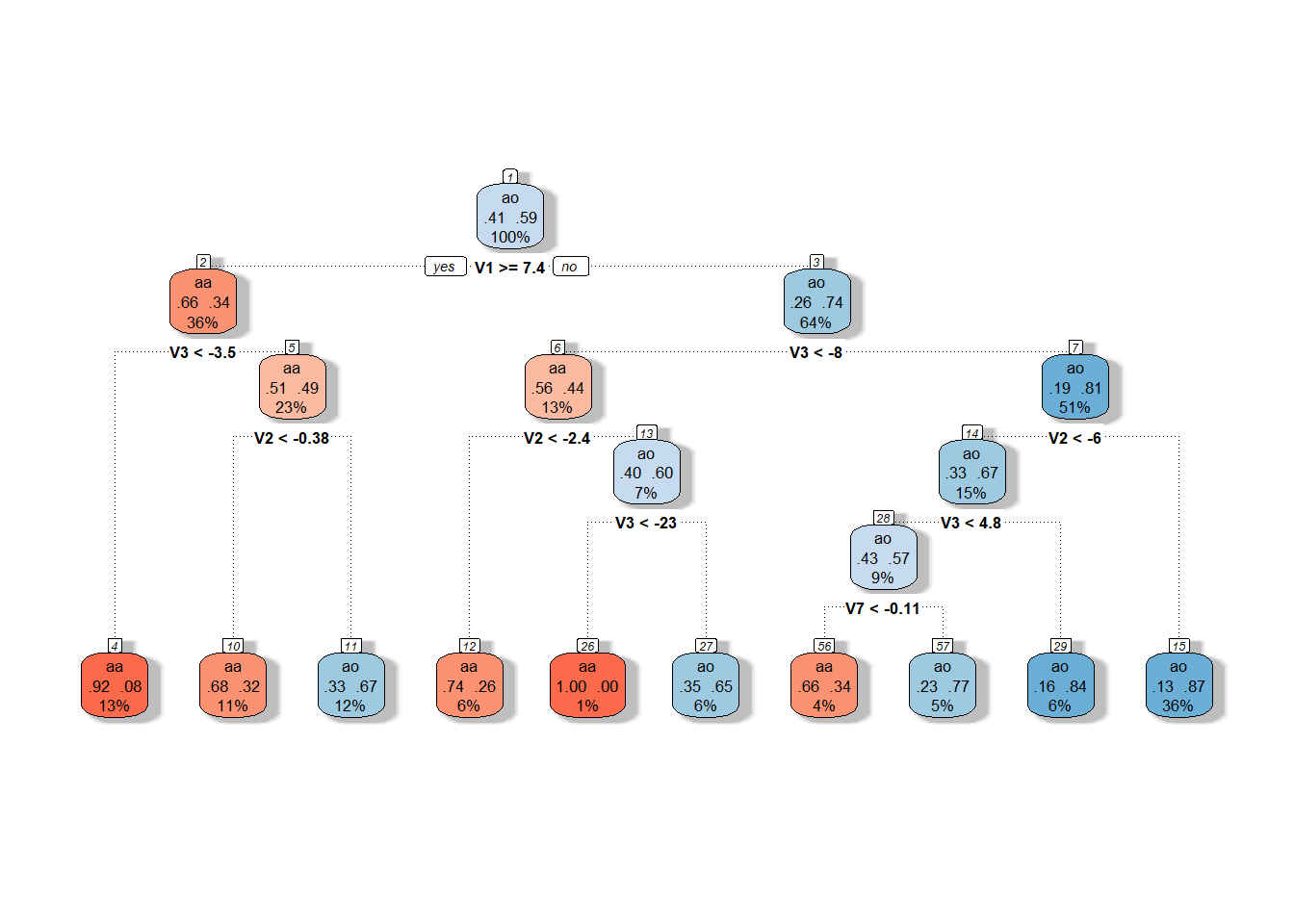

11.2.5.3 Bázové koeficienty

Poslední možností, kterou využijeme pro sestrojení rozhodovacího stromu, je použití koeficientů ve vyjádření funkcí v B-splinové bázi.

Nejprve si definujme potřebné datové soubory s koeficienty.

Code

Nyní již můžeme sestrojit klasifikátor.

Code

# sestrojeni modelu

clf.tree.Bbasis <- train(Y ~ ., data = data.Bbasis.train,

method = "rpart",

trControl = trainControl(method = "CV", number = 10),

metric = "Accuracy")

# presnost na trenovacich datech

predictions.train <- predict(clf.tree.Bbasis, newdata = data.Bbasis.train)

presnost.train <- table(Y.train, predictions.train) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.tree.Bbasis, newdata = data.Bbasis.test)

presnost.test <- table(Y.test, predictions.test) |>

prop.table() |> diag() |> sum()Chybovost rozhodovacího stromu na trénovacích datech je tedy 15.88 % a na testovacích datech 22.1 %.

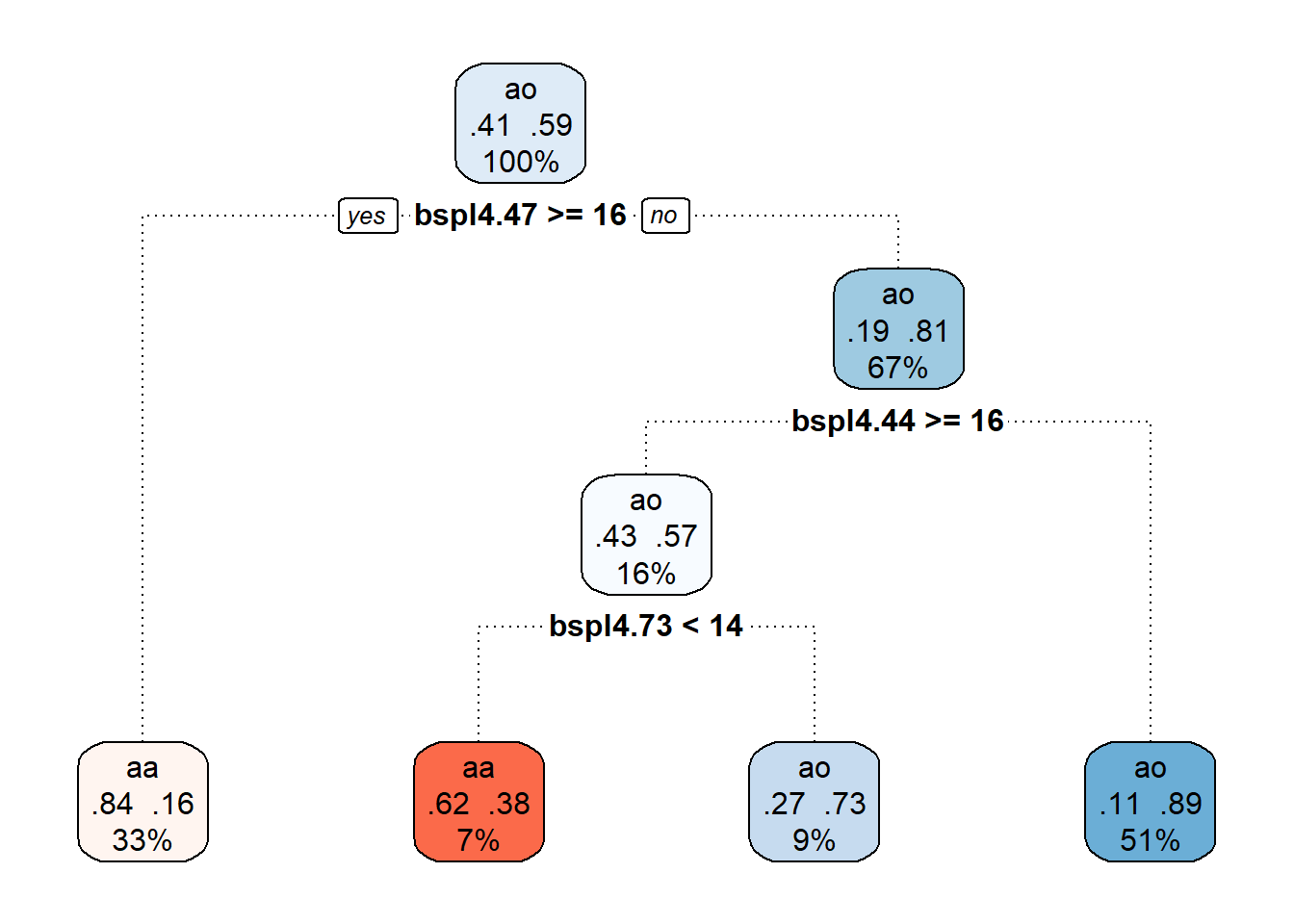

Graficky si rozhodovací strom sestrojený na koeficientech B-splinového vyjádření můžeme vykreslit pomocí funkce fancyRpartPlot().

Nastavíme barvy uzlů tak, aby reflektovaly předchozí barevné odlišení.

Jedná se o neprořezaný strom.

Code

Obrázek 1.19: Grafické znázornění neprořezaného rozhodovacího stromu sestrojeného na bázových koeficientech. Modrými odstíny jsou vykresleny uzly příslušející klasifikační třídě 1 a červenými odstíny třídě 0.

Můžeme si také vykreslit již prořezaný finální rozhodovací strom.

Code

Obrázek 1.20: Finální prořezaný rozhodovací strom.

Nakonec opět přidejme trénovací a testovací chybovost do souhrnné tabulky.

11.2.6 Náhodné lesy

Klasifikátor sestrojený pomocí metody náhodných lesů spočívá v sestrojení několika jednotlivých rozhodovacích stromů, které se následně zkombinují a vytvoří společný klasifikátor (společným “hlasováním”).

Tak jako v případě rozhodovacích stromů máme několik možností na to, jaká data (konečně-rozměrná) použijeme pro sestrojení modelu. Budeme opět uvažovat výše diskutované tři přístupy. Datové soubory s příslušnými veličinami pro všechny tři přístupy již máme připravené z minulé sekce, proto můžeme přímo sestrojit dané modely, spočítat charakteristiky daného klasifikátoru a přidat výsledky do souhrnné tabulky.

11.2.6.1 Diskretizace intervalu

V prvním případě využíváme vyhodnocení funkcí na dané síti bodů intervalu \(I = [1, 256]\).

Code

# sestrojeni modelu

clf.RF <- randomForest(Y ~ ., data = grid.data,

ntree = 500, # pocet stromu

importance = TRUE,

nodesize = 5)

# presnost na trenovacich datech

predictions.train <- predict(clf.RF, newdata = grid.data)

presnost.train <- table(Y.train, predictions.train) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.RF, newdata = grid.data.test)

presnost.test <- table(Y.test, predictions.test) |>

prop.table() |> diag() |> sum()Chybovost náhodného lesu na trénovacích datech je tedy 0.23 % a na testovacích datech 19.82 %.

11.2.6.2 Skóre hlavních komponent

V tomto případě využijeme skóre prvních \(p =\) 9 hlavních komponent.

Code

# sestrojeni modelu

clf.RF.PCA <- randomForest(Y ~ ., data = data.PCA.train,

ntree = 500, # pocet stromu

importance = TRUE,

nodesize = 5)

# presnost na trenovacich datech

predictions.train <- predict(clf.RF.PCA, newdata = data.PCA.train)

presnost.train <- table(Y.train, predictions.train) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.RF.PCA, newdata = data.PCA.test)

presnost.test <- table(Y.test, predictions.test) |>

prop.table() |> diag() |> sum()Chybovost náhodného lesu na trénovacích datech je tedy 0.31 % a na testovacích datech 22.32 %.

11.2.6.3 Bázové koeficienty

Nakonec použijeme vyjádření funkcí pomocí B-splinové báze.

Code

# sestrojeni modelu

clf.RF.Bbasis <- randomForest(Y ~ ., data = data.Bbasis.train,

ntree = 500, # pocet stromu

importance = TRUE,

nodesize = 5)

# presnost na trenovacich datech

predictions.train <- predict(clf.RF.Bbasis, newdata = data.Bbasis.train)

presnost.train <- table(Y.train, predictions.train) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test <- predict(clf.RF.Bbasis, newdata = data.Bbasis.test)

presnost.test <- table(Y.test, predictions.test) |>

prop.table() |> diag() |> sum()Chybovost tohoto klasifikátoru na trénovacích datech je 0.08 % a na testovacích datech 18.91 %.

11.2.7 Support Vector Machines

Nyní se podívejme na klasifikaci našich pomocí metody podpůrných vektorů (ang. Support Vector Machines, SVM). Výhodou této klasifikační metody je její výpočetní nenáročnost, neboť pro definici hraniční křivky mezi třídami využívá pouze několik (často málo) pozorování.

Hlavní výhodou SVM je použití tzv. jádrového triku (kernel trick), pomocí kterého nahradíme obyčejný skalární součin jiným skalárním součinem transformovaných dat, aniž bychom tuto transformaci museli přímo definovat. Tím dostaneme obecně nelineární dělící hranici mezi klasifikačními třídami. Jádro (jádrová funkce, ang. kernel, kernel function) \(K\) je taková funkce, která splňuje

\[ K(x_i, x_j) = \langle \phi(x_i), \phi(x_j) \rangle_{\mathcal H}, \] kde \(\phi\) je nějaká (neznámá) transformace (ang. feature map), \(\mathcal H\) je Hilbertův prostor a \(\langle \cdot, \cdot \rangle_{\mathcal H}\) je nějaký skalární součin na tomto Hilbertově prostoru.

Nejčastěji se v praxi volí tři typy jádrových funkcí:

- lineární jádro – \(K(x_i, x_j) = \langle x_i, x_j \rangle\),

- polynomiální jádro – \(K(x_i, x_j) = \big(\alpha_0 + \gamma \langle x_i, x_j \rangle \big)^d\),

- radiální (gaussovské) jádro – \(\displaystyle{K(x_i, x_j) = \text e^{-\gamma \|x_i - x_j \|^2}}\).

U všech výše zmíněných jader musíme zvolit konstantu \(C > 0\), která udává míru penalizace za překročení dělící hranice mezi třídami (ang. inverse regularization parameter). S rostoucí hodnotou \(C\) bude metoda více penalizovat špatně klasifikovaná data a méně tvar hranice, naopak pro malé hodnoty \(C\) metoda nedává takový význam špatně klasifikovaným datům, ale zaměřuje se více na penalizaci tvaru hranice. Tato konstanta \(C\) se defaultně volí rovna 1, můžeme ji určit i přímo například pomocí cross-validace.

Využitím cross-validace můžeme také určit optimální hodnoty ostatních hyperparametrů, které nyní závisí na naší volbě jádrové funkce.

V případě lineárního jádra nevolíme žádný další parametr kromě konstanty \(C\), u polynomiálního a radiálního jádra musíme určit hodnoty hyperparametrů \(\alpha_0, \gamma \text{ a } d\), jejichž defaultní hodnoty v R jsou postupně \(\alpha_0^{default} = 0, \gamma^{default} = \frac{1}{dim(\texttt{data})} \text{ a } d^{default} = 3\).

Opět bychom mohli hodnoty hyperparametrů určit jako optimální pro naše data, avšak vzhledem k relativní výpočetní náročnosti necháme hodnoty příslušných hyperparametrů na jejich defaultních hodnotách, avšak lepší volbou se zdá být \(\alpha_0^{default} = 1\).

V případě funkcionálních dat máme několik možností, jak použít metodu SVM. Nejjednodušší variantou je použít tuto klasifikační metodu přímo na diskretizovanou funkci (sekce 11.2.7.1). Další možností je opět využít skóre hlavních komponent a klasifikovat křivky pomocí jejich reprezentace 11.2.7.2. Další přímočarou variantou je využít vyjádření křivek pomocí B-splinové báze a klasifikovat křivky na základě koeficientů jejich vyjádření v této bázi (sekce 11.2.7.3).

Složitější úvahou můžeme dospět k několika dalším možnostem, které využívají funkcionální podstatu dat. Jednak můžeme místo klasifikace původní křivky využít její derivaci (případně druhou derivaci, třetí, …), druhak můžeme využít projekce funkcí na podprostor generovaný, např. B-splinovými, funkcemi (sekce 11.2.7.4). Poslední metoda, kterou použijeme pro klasifikaci funkcionálních dat, spočívá v kombinaci projekce na určitý podprostor generovaný funkcemi (Reproducing Kernel Hilbert Space, RKHS) a klasifikace příslušné reprezentace. Tato metoda využívá kromě klasického SVM i SVM pro regresi, více uvádíme v sekci RKHS + SVM 11.2.7.5.

11.2.7.1 Diskretizace intervalu

Začněme nejprve aplikací metody podpůrných vektorů přímo na diskretizovaná data (vyhodnocení funkce na dané síti bodů na intervalu \(I = [1, 256]\)), přičemž budeme uvažovat všechny tři výše zmíněné jádrové funkce. Nejprve funkcionální pozorování normujeme, čímž dosáhneme ještě o něco menší testovací chybovosti.

Code

# set norm equal to one

norms <- c()

for (i in 1:dim(XXfd$coefs)[2]) {

norms <- c(norms, as.numeric(1 / norm.fd(BSmooth$fd[i])))

}

XXfd_norm <- XXfd

XXfd_norm$coefs <- XXfd_norm$coefs * matrix(norms,

ncol = dim(XXfd$coefs)[2],

nrow = dim(XXfd$coefs)[1],

byrow = T)

# rozdeleni na testovaci a trenovaci cast

split_norm <- ifelse(substr(XXfd_norm$fdnames$reps, 1, 2) == 'tr', TRUE, FALSE)

X.train_norm <- subset(XXfd_norm, split_norm == TRUE)

X.test_norm <- subset(XXfd_norm, split_norm == FALSE)

Y.train_norm <- subset(y, split_norm == TRUE)

Y.test_norm <- subset(y, split_norm == FALSE)

grid.data <- eval.fd(fdobj = X.train_norm, evalarg = t.seq)

grid.data <- as.data.frame(t(grid.data))

grid.data$Y <- Y.train_norm |> factor()

grid.data.test <- eval.fd(fdobj = X.test_norm, evalarg = t.seq)

grid.data.test <- as.data.frame(t(grid.data.test))

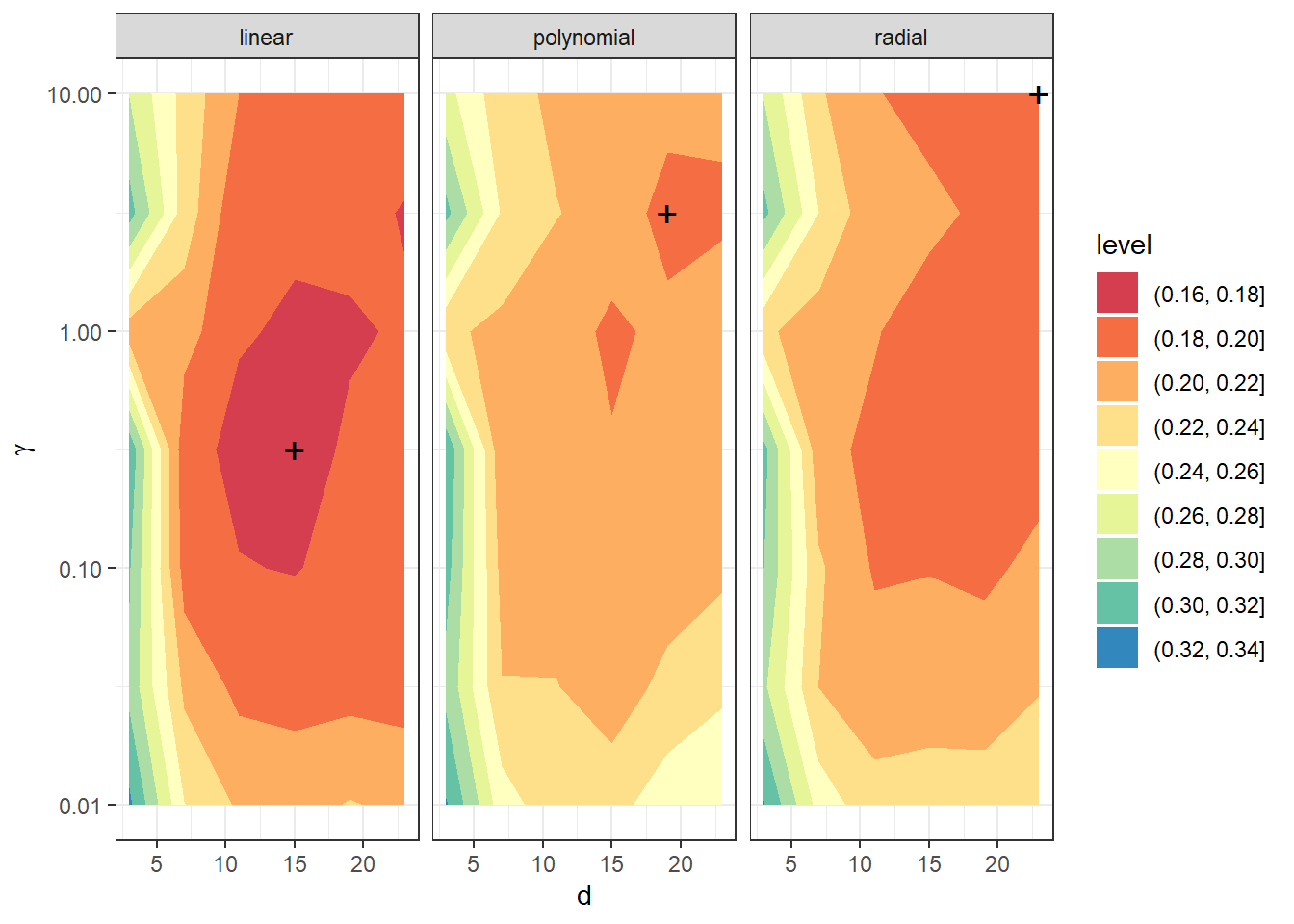

grid.data.test$Y <- Y.test_norm |> factor()Nyní se pokusme, na rozdíl od postupu v předchozích kapitolách, hyperparametry klasifikátorů odhadnout z dat pomocí 10-násobné cross-validace. Vzhledem k tomu, že každé jádro má ve své definici jiné hyperparametry, budeme ke každé jádrové funkci přistupovat zvlášť. Nicméně hyperparametr \(C\) vystupuje u všech jádrových funkcí, přičemž ale připouštíme, že se může jeho optimální hodnota mezi jádry lišit.

U všech třech jader projdeme hodnoty hyperparametru \(C\) v intervalu \([10^{-3}, 10^{3}]\), přičemž u jádra polynomiálního zafixujeme hyperparametr \(p\) na hodnotě 3, neboť pro jiné celočíselné hodnoty metoda nedává zdaleka tak dobré výsledky. Naopak pro radiální jádro využijeme k volbě optimální hodnoty hyperparametru \(\gamma\) opět 10-násobnou CV, přičemž uvažujeme hodnoty v intervalu \([10^{-3}, 10^{2}]\). Zvolíme coef0 \(= 1\).

Code

set.seed(42)

k_cv <- 10 # k-fold CV

# rozdelime trenovaci data na k casti

folds <- createMultiFolds(1:sum(split_norm), k = k_cv, time = 1)

# ktere hodnoty gamma chceme uvazovat

gamma.cv <- 10^seq(-3, 2, length = 10)

C.cv <- 10^seq(-3, 3, length = 10)

p.cv <- 3

coef0 <- 1

# list se tremi slozkami ... array pro jednotlive jadra -> linear, poly, radial

# prazdna matice, do ktere vlozime jednotlive vysledky

# ve sloupcich budou hodnoty presnosti pro dane

# v radcich budou hodnoty pro danou gamma a vrstvy odpovidaji folds

CV.results <- list(

SVM.l = array(NA, dim = c(length(C.cv), k_cv)),

SVM.p = array(NA, dim = c(length(C.cv), length(p.cv), k_cv)),

SVM.r = array(NA, dim = c(length(C.cv), length(gamma.cv), k_cv))

)

# nejprve projdeme hodnoty C

for (C in C.cv) {

# projdeme jednotlive folds

for (index_cv in 1:k_cv) {

# definice testovaci a trenovaci casti pro CV

fold <- folds[[index_cv]]

cv_sample <- 1:dim(grid.data)[1] %in% fold

data.grid.train.cv <- as.data.frame(grid.data[cv_sample, ])

data.grid.test.cv <- as.data.frame(grid.data[!cv_sample, ])

## LINEARNI JADRO

# sestrojeni modelu

clf.SVM.l <- svm(Y ~ ., data = data.grid.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

kernel = 'linear')

# presnost na validacnich datech

predictions.test.l <- predict(clf.SVM.l, newdata = data.grid.test.cv)

presnost.test.l <- table(data.grid.test.cv$Y, predictions.test.l) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C a fold

CV.results$SVM.l[(1:length(C.cv))[C.cv == C],

index_cv] <- presnost.test.l

## POLYNOMIALNI JADRO

for (p in p.cv) {

# sestrojeni modelu

clf.SVM.p <- svm(Y ~ ., data = data.grid.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

coef0 = coef0,

degree = p,

kernel = 'polynomial')

# presnost na validacnich datech

predictions.test.p <- predict(clf.SVM.p, newdata = data.grid.test.cv)

presnost.test.p <- table(data.grid.test.cv$Y, predictions.test.p) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C, p a fold

CV.results$SVM.p[(1:length(C.cv))[C.cv == C],

(1:length(p.cv))[p.cv == p],

index_cv] <- presnost.test.p

}

## RADIALNI JADRO

for (gamma in gamma.cv) {

# sestrojeni modelu

clf.SVM.r <- svm(Y ~ ., data = data.grid.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

gamma = gamma,

kernel = 'radial')

# presnost na validacnich datech

predictions.test.r <- predict(clf.SVM.r, newdata = data.grid.test.cv)

presnost.test.r <- table(data.grid.test.cv$Y, predictions.test.r) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C, gamma a fold

CV.results$SVM.r[(1:length(C.cv))[C.cv == C],

(1:length(gamma.cv))[gamma.cv == gamma],

index_cv] <- presnost.test.r

}

}

}Nyní zprůměrujeme výsledky 10-násobné CV tak, abychom pro jednu hodnotu hyperparametru (případně jednu kombinaci hodnot) měli jeden odhad validační chybovosti. Přitom určíme i optimální hodnoty jednotlivých hyperparametrů.

Code

# spocitame prumerne presnosti pro jednotliva C pres folds

## Linearni jadro

CV.results$SVM.l <- apply(CV.results$SVM.l, 1, mean)

## Polynomialni jadro

CV.results$SVM.p <- apply(CV.results$SVM.p, c(1, 2), mean)

## Radialni jadro

CV.results$SVM.r <- apply(CV.results$SVM.r, c(1, 2), mean)

C.opt <- c(which.max(CV.results$SVM.l),

which.max(CV.results$SVM.p) %% length(C.cv),

which.max(CV.results$SVM.r) %% length(C.cv))

C.opt[C.opt == 0] <- length(C.cv)

C.opt <- C.cv[C.opt]

gamma.opt <- which.max(t(CV.results$SVM.r)) %% length(gamma.cv)

gamma.opt[gamma.opt == 0] <- length(gamma.cv)

gamma.opt <- gamma.cv[gamma.opt]

p.opt <- which.max(t(CV.results$SVM.p)) %% length(p.cv)

p.opt[p.opt == 0] <- length(p.cv)

p.opt <- p.cv[p.opt]

presnost.opt.cv <- c(max(CV.results$SVM.l),

max(CV.results$SVM.p),

max(CV.results$SVM.r))Podívejme se, jak dopadly optimální hodnoty. Pro lineární jádro máme optimální hodnotu \(C\) rovnu 0.1, pro polynomiální jádro je \(C\) rovno 0.1 a pro radiální jádro máme dvě optimální hodnoty, pro \(C\) je optimální hodnota 2.1544 a pro \(\gamma\) je to 0.001. Validační chybovosti jsou postupně 0.1651206 pro lineární, 0.1846703 pro polynomiální a 0.1729331 pro radiální jádro.

Konečně můžeme sestrojit finální klasifikátory na celých trénovacích datech s hodnotami hyperparametrů určenými pomocí 10-násobné CV. Určíme také chybovosti na testovacích a také na trénovacích datech.

Code

# sestrojeni modelu

clf.SVM.l <- svm(Y ~ ., data = grid.data,

type = 'C-classification',

scale = TRUE,

cost = C.opt[1],

kernel = 'linear')

clf.SVM.p <- svm(Y ~ ., data = grid.data,

type = 'C-classification',

scale = TRUE,

cost = C.opt[2],

degree = p.opt,

coef0 = coef0,

kernel = 'polynomial')

clf.SVM.r <- svm(Y ~ ., data = grid.data,

type = 'C-classification',

scale = TRUE,

cost = C.opt[3],

gamma = gamma.opt,

kernel = 'radial')

# presnost na trenovacich datech

predictions.train.l <- predict(clf.SVM.l, newdata = grid.data)

presnost.train.l <- table(Y.train, predictions.train.l) |>

prop.table() |> diag() |> sum()

predictions.train.p <- predict(clf.SVM.p, newdata = grid.data)

presnost.train.p <- table(Y.train, predictions.train.p) |>

prop.table() |> diag() |> sum()

predictions.train.r <- predict(clf.SVM.r, newdata = grid.data)

presnost.train.r <- table(Y.train, predictions.train.r) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test.l <- predict(clf.SVM.l, newdata = grid.data.test)

presnost.test.l <- table(Y.test, predictions.test.l) |>

prop.table() |> diag() |> sum()

predictions.test.p <- predict(clf.SVM.p, newdata = grid.data.test)

presnost.test.p <- table(Y.test, predictions.test.p) |>

prop.table() |> diag() |> sum()

predictions.test.r <- predict(clf.SVM.r, newdata = grid.data.test)

presnost.test.r <- table(Y.test, predictions.test.r) |>

prop.table() |> diag() |> sum()Chybovost metody SVM na trénovacích datech je tedy 15.6495 % pro lineární jádro, 13.928 % pro polynomiální jádro a 16.4319 % pro gaussovské jádro. Na testovacích datech je potom chybovost metody 20.0456 % pro lineární jádro, 18.9066 % pro polynomiální jádro a 18.9066 % pro radiální jádro.

11.2.7.2 Skóre hlavních komponent

V tomto případě využijeme skóre prvních \(p =\) 9 hlavních komponent.

Nyní se pokusme, na rozdíl od postupu v předchozích kapitolách, hyperparametry klasifikátorů odhadnout z dat pomocí 10-násobné cross-validace. Vzhledem k tomu, že každé jádro má ve své definici jiné hyperparametry, budeme ke každé jádrové funkci přistupovat zvlášť. Nicméně hyperparametr \(C\) vystupuje u všech jádrových funkcí, přičemž ale připouštíme, že se může jeho optimální hodnota mezi jádry lišit.

U všech třech jader projdeme hodnoty hyperparametru \(C\) v intervalu \([10^{-3}, 10^{3}]\), přičemž u jádra polynomiálního zafixujeme hyperparametr \(p\) na hodnotě 3, neboť pro jiné celočíselné hodnoty metoda nedává zdaleka tak dobré výsledky. Naopak pro radiální jádro využijeme k volbě optimální hodnoty hyperparametru \(\gamma\) opět 10-násobnou CV, přičemž uvažujeme hodnoty v intervalu \([10^{-3}, 10^{2}]\). Zvolíme coef0 \(= 1\).

Code

set.seed(42)

# ktere hodnoty gamma chceme uvazovat

gamma.cv <- 10^seq(-3, 2, length = 10)

C.cv <- 10^seq(-3, 3, length = 10)

p.cv <- 3

coef0 <- 1

# list se tremi slozkami ... array pro jednotlive jadra -> linear, poly, radial

# prazdna matice, do ktere vlozime jednotlive vysledky

# ve sloupcich budou hodnoty presnosti pro dane

# v radcich budou hodnoty pro danou gamma a vrstvy odpovidaji folds

CV.results <- list(

SVM.l = array(NA, dim = c(length(C.cv), k_cv)),

SVM.p = array(NA, dim = c(length(C.cv), length(p.cv), k_cv)),

SVM.r = array(NA, dim = c(length(C.cv), length(gamma.cv), k_cv))

)

# nejprve projdeme hodnoty C

for (C in C.cv) {

# projdeme jednotlive folds

for (index_cv in 1:k_cv) {

# definice testovaci a trenovaci casti pro CV

fold <- folds[[index_cv]]

cv_sample <- 1:dim(data.PCA.train)[1] %in% fold

data.PCA.train.cv <- as.data.frame(data.PCA.train[cv_sample, ])

data.PCA.test.cv <- as.data.frame(data.PCA.train[!cv_sample, ])

## LINEARNI JADRO

# sestrojeni modelu

clf.SVM.l <- svm(Y ~ ., data = data.PCA.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

kernel = 'linear')

# presnost na validacnich datech

predictions.test.l <- predict(clf.SVM.l, newdata = data.PCA.test.cv)

presnost.test.l <- table(data.PCA.test.cv$Y, predictions.test.l) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C a fold

CV.results$SVM.l[(1:length(C.cv))[C.cv == C],

index_cv] <- presnost.test.l

## POLYNOMIALNI JADRO

for (p in p.cv) {

# sestrojeni modelu

clf.SVM.p <- svm(Y ~ ., data = data.PCA.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

coef0 = coef0,

degree = p,

kernel = 'polynomial')

# presnost na validacnich datech

predictions.test.p <- predict(clf.SVM.p, newdata = data.PCA.test.cv)

presnost.test.p <- table(data.PCA.test.cv$Y, predictions.test.p) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C, p a fold

CV.results$SVM.p[(1:length(C.cv))[C.cv == C],

(1:length(p.cv))[p.cv == p],

index_cv] <- presnost.test.p

}

## RADIALNI JADRO

for (gamma in gamma.cv) {

# sestrojeni modelu

clf.SVM.r <- svm(Y ~ ., data = data.PCA.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

gamma = gamma,

kernel = 'radial')

# presnost na validacnich datech

predictions.test.r <- predict(clf.SVM.r, newdata = data.PCA.test.cv)

presnost.test.r <- table(data.PCA.test.cv$Y, predictions.test.r) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C, gamma a fold

CV.results$SVM.r[(1:length(C.cv))[C.cv == C],

(1:length(gamma.cv))[gamma.cv == gamma],

index_cv] <- presnost.test.r

}

}

}Nyní zprůměrujeme výsledky 10-násobné CV tak, abychom pro jednu hodnotu hyperparametru (případně jednu kombinaci hodnot) měli jeden odhad validační chybovosti. Přitom určíme i optimální hodnoty jednotlivých hyperparametrů.

Code

# spocitame prumerne presnosti pro jednotliva C pres folds

## Linearni jadro

CV.results$SVM.l <- apply(CV.results$SVM.l, 1, mean)

## Polynomialni jadro

CV.results$SVM.p <- apply(CV.results$SVM.p, c(1, 2), mean)

## Radialni jadro

CV.results$SVM.r <- apply(CV.results$SVM.r, c(1, 2), mean)

C.opt <- c(which.max(CV.results$SVM.l),

which.max(CV.results$SVM.p) %% length(C.cv),

which.max(CV.results$SVM.r) %% length(C.cv))

C.opt[C.opt == 0] <- length(C.cv)

C.opt <- C.cv[C.opt]

gamma.opt <- which.max(t(CV.results$SVM.r)) %% length(gamma.cv)

gamma.opt[gamma.opt == 0] <- length(gamma.cv)

gamma.opt <- gamma.cv[gamma.opt]

p.opt <- which.max(t(CV.results$SVM.p)) %% length(p.cv)

p.opt[p.opt == 0] <- length(p.cv)

p.opt <- p.cv[p.opt]

presnost.opt.cv <- c(max(CV.results$SVM.l),

max(CV.results$SVM.p),

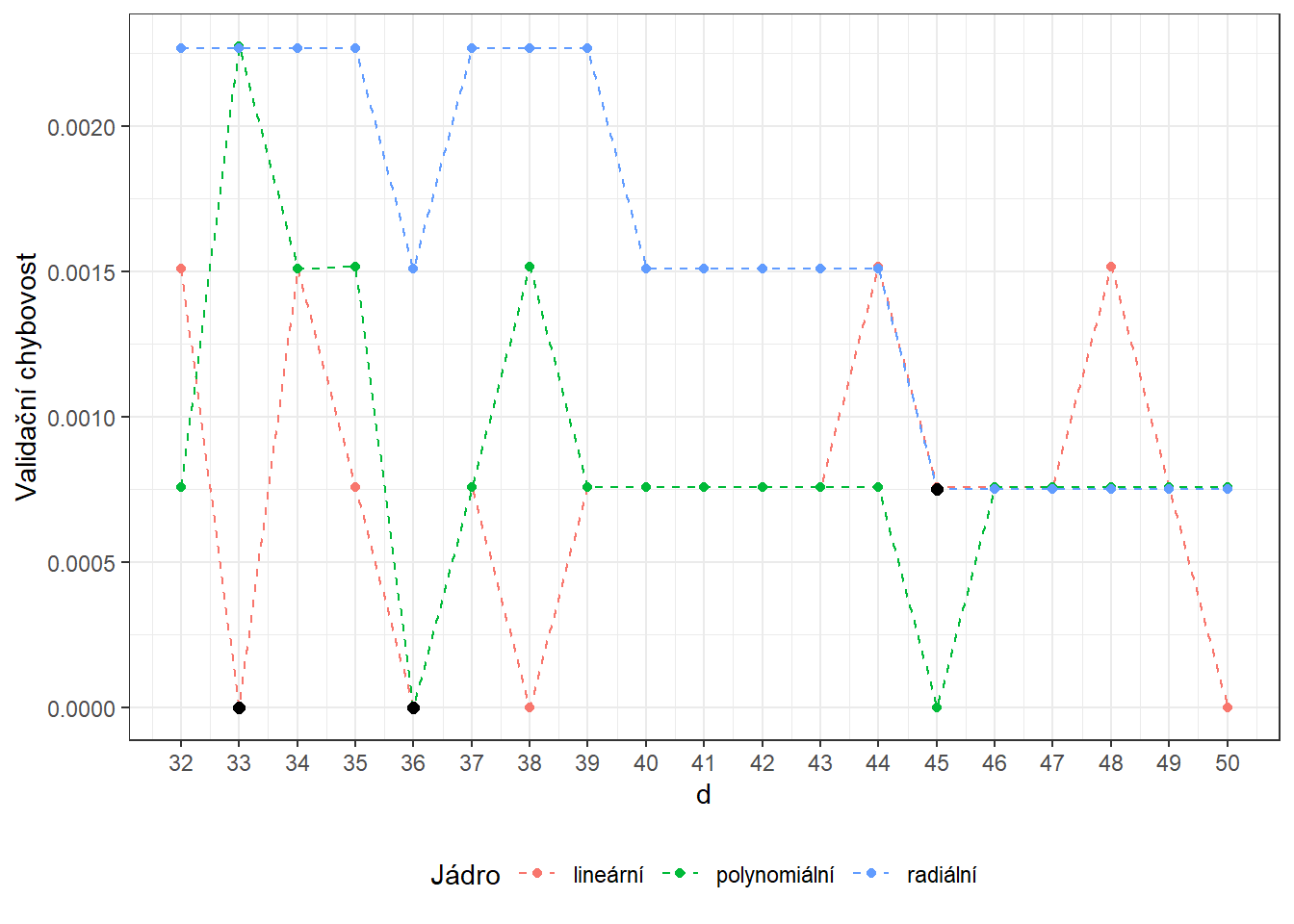

max(CV.results$SVM.r))Podívejme se, jak dopadly optimální hodnoty. Pro lineární jádro máme optimální hodnotu \(C\) rovnu 0.0046, pro polynomiální jádro je \(C\) rovno 0.1 a pro radiální jádro máme dvě optimální hodnoty, pro \(C\) je optimální hodnota 1000 a pro \(\gamma\) je to 0.001. Validační chybovosti jsou postupně 0.2034633 pro lineární, 0.2065822 pro polynomiální a 0.1987635 pro radiální jádro.

Konečně můžeme sestrojit finální klasifikátory na celých trénovacích datech s hodnotami hyperparametrů určenými pomocí 10-násobné CV. Určíme také chybovosti na testovacích a také na trénovacích datech.

Code

# sestrojeni modelu

clf.SVM.l.PCA <- svm(Y ~ ., data = data.PCA.train,

type = 'C-classification',

scale = TRUE,

cost = C.opt[1],

kernel = 'linear')

clf.SVM.p.PCA <- svm(Y ~ ., data = data.PCA.train,

type = 'C-classification',

scale = TRUE,

cost = C.opt[2],

degree = p.opt,

coef0 = coef0,

kernel = 'polynomial')

clf.SVM.r.PCA <- svm(Y ~ ., data = data.PCA.train,

type = 'C-classification',

scale = TRUE,

cost = C.opt[3],

gamma = gamma.opt,

kernel = 'radial')

# presnost na trenovacich datech

predictions.train.l <- predict(clf.SVM.l.PCA, newdata = data.PCA.train)

presnost.train.l <- table(data.PCA.train$Y, predictions.train.l) |>

prop.table() |> diag() |> sum()

predictions.train.p <- predict(clf.SVM.p.PCA, newdata = data.PCA.train)

presnost.train.p <- table(data.PCA.train$Y, predictions.train.p) |>

prop.table() |> diag() |> sum()

predictions.train.r <- predict(clf.SVM.r.PCA, newdata = data.PCA.train)

presnost.train.r <- table(data.PCA.train$Y, predictions.train.r) |>

prop.table() |> diag() |> sum()

# presnost na testovacich datech

predictions.test.l <- predict(clf.SVM.l.PCA, newdata = data.PCA.test)

presnost.test.l <- table(data.PCA.test$Y, predictions.test.l) |>

prop.table() |> diag() |> sum()

predictions.test.p <- predict(clf.SVM.p.PCA, newdata = data.PCA.test)

presnost.test.p <- table(data.PCA.test$Y, predictions.test.p) |>

prop.table() |> diag() |> sum()

predictions.test.r <- predict(clf.SVM.r.PCA, newdata = data.PCA.test)

presnost.test.r <- table(data.PCA.test$Y, predictions.test.r) |>

prop.table() |> diag() |> sum()Chybovost metody SVM aplikované na skóre hlavních komponent na trénovacích datech je tedy 19.95 % pro lineární jádro, 17.14 % pro polynomiální jádro a 18.39 % pro gaussovské jádro. Na testovacích datech je potom chybovost metody 20.7289 % pro lineární jádro, 18.6788 % pro polynomiální jádro a 19.8178 % pro radiální jádro.

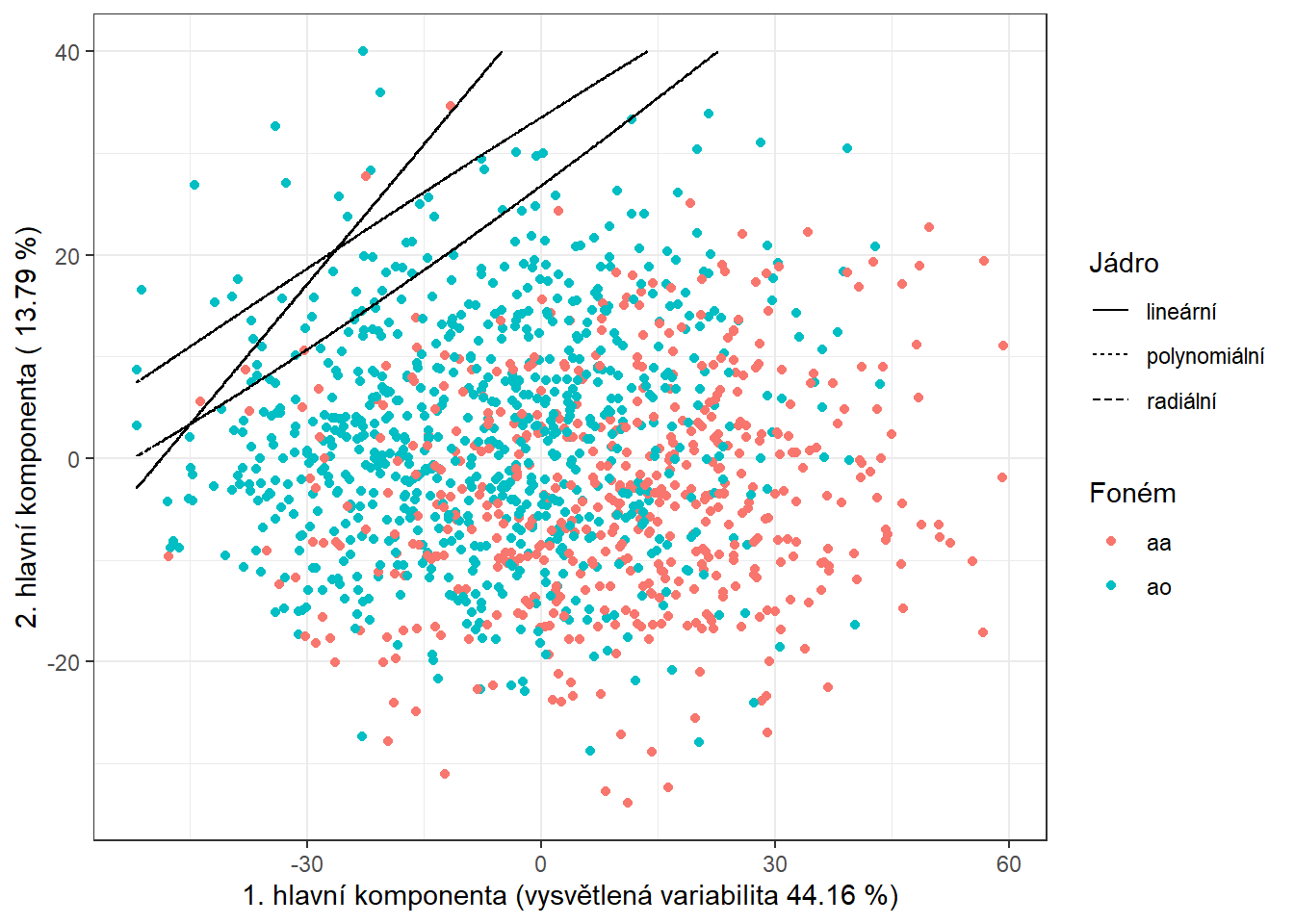

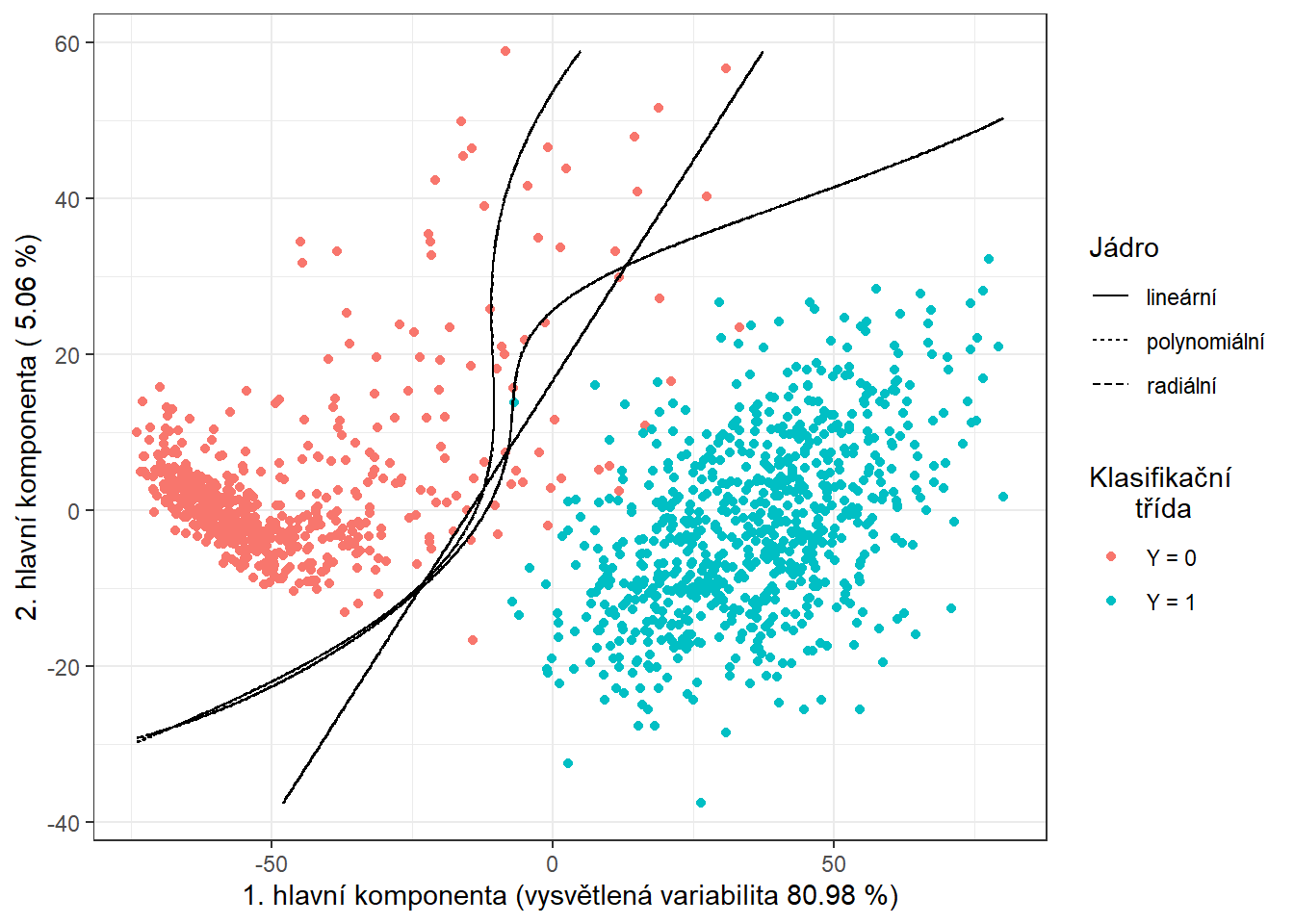

Pro grafické znázornění metody můžeme zaznačit dělící hranici do grafu skórů prvních dvou hlavních komponent.

Tuto hranici spočítáme na husté síti bodů a zobrazíme ji pomocí funkce geom_contour() stejně jako v předchozích případech, kdy jsme také vykreslovali klasifikační hranici.

Code

nd <- rbind(nd, nd, nd) |> mutate(

prd = c(as.numeric(predict(clf.SVM.l.PCA, newdata = nd, type = 'response')),

as.numeric(predict(clf.SVM.p.PCA, newdata = nd, type = 'response')),

as.numeric(predict(clf.SVM.r.PCA, newdata = nd, type = 'response'))),

kernel = rep(c('lineární', 'polynomiální', 'radiální'),

each = length(as.numeric(predict(clf.SVM.l.PCA,

newdata = nd,

type = 'response')))) |>

as.factor())

data.PCA.train |> ggplot(aes(x = V1, y = V2, colour = Y)) +

geom_point(size = 1.5) +

labs(x = paste('1. hlavní komponenta (vysvětlená variabilita',

round(100 * data.PCA$varprop[1], 2), '%)'),

y = paste('2. hlavní komponenta (',

round(100 * data.PCA$varprop[2], 2), '%)'),

colour = 'Foném',

linetype = 'Jádro') +

scale_colour_discrete(labels = phoneme_subset) +

theme_bw() +

geom_contour(data = nd, aes(x = V1, y = V2, z = prd, linetype = kernel),

colour = 'black')

Obrázek 11.1: Skóre prvních dvou hlavních komponent, barevně odlišené podle příslušnosti do klasifikační třídy. Černě je vyznačena dělící hranice (přímka, resp. křivky v rovině prvních dvou hlavních komponent) mezi třídami sestrojená pomocí metody SVM.

11.2.7.3 Bázové koeficienty

Nakonec použijeme vyjádření funkcí pomocí B-splinové báze.

U všech třech jader projdeme hodnoty hyperparametru \(C\) v intervalu \([10^{-3}, 10^{3}]\), přičemž u jádra polynomiálního zafixujeme hyperparametr \(p\) na hodnotě 3, neboť pro jiné celočíselné hodnoty metoda nedává zdaleka tak dobré výsledky. Naopak pro radiální jádro využijeme k volbě optimální hodnoty hyperparametru \(\gamma\) opět 10-násobnou CV, přičemž uvažujeme hodnoty v intervalu \([10^{-3}, 10^{2}]\). Zvolíme coef0 \(= 1\).

Code

set.seed(42)

# ktere hodnoty gamma chceme uvazovat

gamma.cv <- 10^seq(-3, 2, length = 10)

C.cv <- 10^seq(-3, 3, length = 10)

p.cv <- 3

coef0 <- 1

# list se tremi slozkami ... array pro jednotlive jadra -> linear, poly, radial

# prazdna matice, do ktere vlozime jednotlive vysledky

# ve sloupcich budou hodnoty presnosti pro dane

# v radcich budou hodnoty pro danou gamma a vrstvy odpovidaji folds

CV.results <- list(

SVM.l = array(NA, dim = c(length(C.cv), k_cv)),

SVM.p = array(NA, dim = c(length(C.cv), length(p.cv), k_cv)),

SVM.r = array(NA, dim = c(length(C.cv), length(gamma.cv), k_cv))

)

# nejprve projdeme hodnoty C

for (C in C.cv) {

# projdeme jednotlive folds

for (index_cv in 1:k_cv) {

# definice testovaci a trenovaci casti pro CV

fold <- folds[[index_cv]]

cv_sample <- 1:dim(grid.data)[1] %in% fold

data.Bbasis.train.cv <- as.data.frame(data.Bbasis.train[cv_sample, ])

data.Bbasis.test.cv <- as.data.frame(data.Bbasis.train[!cv_sample, ])

## LINEARNI JADRO

# sestrojeni modelu

clf.SVM.l <- svm(Y ~ ., data = data.Bbasis.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

kernel = 'linear')

# presnost na validacnich datech

predictions.test.l <- predict(clf.SVM.l, newdata = data.Bbasis.test.cv)

presnost.test.l <- table(data.Bbasis.test.cv$Y, predictions.test.l) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C a fold

CV.results$SVM.l[(1:length(C.cv))[C.cv == C],

index_cv] <- presnost.test.l

## POLYNOMIALNI JADRO

for (p in p.cv) {

# sestrojeni modelu

clf.SVM.p <- svm(Y ~ ., data = data.Bbasis.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

coef0 = coef0,

degree = p,

kernel = 'polynomial')

# presnost na validacnich datech

predictions.test.p <- predict(clf.SVM.p,

newdata = data.Bbasis.test.cv)

presnost.test.p <- table(data.Bbasis.test.cv$Y, predictions.test.p) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C, p a fold

CV.results$SVM.p[(1:length(C.cv))[C.cv == C],

(1:length(p.cv))[p.cv == p],

index_cv] <- presnost.test.p

}

## RADIALNI JADRO

for (gamma in gamma.cv) {

# sestrojeni modelu

clf.SVM.r <- svm(Y ~ ., data = data.Bbasis.train.cv,

type = 'C-classification',

scale = TRUE,

cost = C,

gamma = gamma,

kernel = 'radial')

# presnost na validacnich datech

predictions.test.r <- predict(clf.SVM.r,

newdata = data.Bbasis.test.cv)

presnost.test.r <- table(data.Bbasis.test.cv$Y, predictions.test.r) |>

prop.table() |> diag() |> sum()

# presnosti vlozime na pozice pro dane C, gamma a fold

CV.results$SVM.r[(1:length(C.cv))[C.cv == C],

(1:length(gamma.cv))[gamma.cv == gamma],

index_cv] <- presnost.test.r

}

}

}Nyní zprůměrujeme výsledky 10-násobné CV tak, abychom pro jednu hodnotu hyperparametru (případně jednu kombinaci hodnot) měli jeden odhad validační chybovosti. Přitom určíme i optimální hodnoty jednotlivých hyperparametrů.

Code

# spocitame prumerne presnosti pro jednotliva C pres folds

## Linearni jadro

CV.results$SVM.l <- apply(CV.results$SVM.l, 1, mean)

## Polynomialni jadro

CV.results$SVM.p <- apply(CV.results$SVM.p, c(1, 2), mean)

## Radialni jadro

CV.results$SVM.r <- apply(CV.results$SVM.r, c(1, 2), mean)

C.opt <- c(which.max(CV.results$SVM.l),

which.max(CV.results$SVM.p) %% length(C.cv),

which.max(CV.results$SVM.r) %% length(C.cv))

C.opt[C.opt == 0] <- length(C.cv)

C.opt <- C.cv[C.opt]

gamma.opt <- which.max(t(CV.results$SVM.r)) %% length(gamma.cv)

gamma.opt[gamma.opt == 0] <- length(gamma.cv)

gamma.opt <- gamma.cv[gamma.opt]

p.opt <- which.max(t(CV.results$SVM.p)) %% length(p.cv)

p.opt[p.opt == 0] <- length(p.cv)

p.opt <- p.cv[p.opt]

presnost.opt.cv <- c(max(CV.results$SVM.l),

max(CV.results$SVM.p),

max(CV.results$SVM.r))Podívejme se, jak dopadly optimální hodnoty. Pro lineární jádro máme optimální hodnotu \(C\) rovnu 0.1, pro polynomiální jádro je \(C\) rovno 0.1 a pro radiální jádro máme dvě optimální hodnoty, pro \(C\) je optimální hodnota 0.4642 a pro \(\gamma\) je to 0.001. Validační chybovosti jsou postupně 0.1627891 pro lineární, 0.1886011 pro polynomiální a 0.1831139 pro radiální jádro.

Konečně můžeme sestrojit finální klasifikátory na celých trénovacích datech s hodnotami hyperparametrů určenými pomocí 10-násobné CV. Určíme také chybovosti na testovacích a také na trénovacích datech.

Code

# sestrojeni modelu

clf.SVM.l.Bbasis <- svm(Y ~ ., data = data.Bbasis.train,

type = 'C-classification',

scale = TRUE,

cost = C.opt[1],

kernel = 'linear')

clf.SVM.p.Bbasis <- svm(Y ~ ., data = data.Bbasis.train,

type = 'C-classification',

scale = TRUE,

cost = C.opt[2],

degree = p.opt,

coef0 = coef0,

kernel = 'polynomial')

clf.SVM.r.Bbasis <- svm(Y ~ ., data = data.Bbasis.train,

type = 'C-classification',

scale = TRUE,

cost = C.opt[3],

gamma = gamma.opt,

kernel = 'radial')

# presnost na trenovacich datech

predictions.train.l <- predict(clf.SVM.l.Bbasis, newdata = data.Bbasis.train)

presnost.train.l <- table(Y.train, predictions.train.l) |>

prop.table() |> diag() |> sum()